<<

From Expert Systems to Generative Artificial Experts A New Concept for Human-AI Collaboration in Knowledge Work

---

## Page 1

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p001.png)

### 和訳

Journal of Artificial Intelligence Research 82 (2025) 2101-2124

2024年9月投稿;2025年4月出版

エキスパートシステムから生成型人工エキスパートへ:

知識労働における人間とAIのコラボレーションの新しいコンセプト

Konrad Sowa KOSOWA@KOZMINSKI.EDU.PL

Aleksandra Przegalinska APRZEGALINSKA@KOZMINSKI.EDU.PL

HumanRace 人間-機械インタラクション研究センター、コズミンスキー大学

ヤギェロンスカ通り57/59番地、03-301 ワルシャワ、ポーランド

要旨

この論文な、生成型人工エキスパート(GAEs)っていう新しいコンセプトを紹介してんねん。これ何かっていうと、知識労働で人間とAIが一緒に仕事するために設計された、新しいタイプの生成AIエージェントのことやねん。GAEsはな、特定の分野に特化した専門知識を持ってて、決められた範囲内で自律的に仕事して、合成されたペルソナを持ってて、マルチモーダルな生成AI能力も備えてんねん。他にもいろんな特徴があるで。ここでは7つの特徴を含むGAEsの定義を示してて、他の生成AIシステムとどう違うかっていう分類法も提案してんねん。文献レビューに基づく概念分析とアブダクション推論(観察された事実から最も妥当な説明を導く推論方法やな)を使って、既存システムの限界を克服する新しいコンセプトを提案してるわけや。この論文では、GAEsがエキスパートシステムからの進化としてどう登場してきたかを探ってんねん。GAEsを可能にする2つの要因も挙げてて、1つは人間とAIの協働っていう研究分野の発展、もう1つは生成AI システムの能力向上やねん。既存の生成AIエージェントについても議論してて、GAEs自体はまだ存在してへんけど、徐々に出現し始めてるって指摘してんねん。この論文は概念的なもんやから、GAEs開発の技術的な側面には踏み込んでへんねん。その代わり、具体例を使ってGAEsの応用可能性と、知識労働の未来における役割を示してるで。

1. はじめに

生成AIの分野はな、ここ数年でめっちゃ進歩してんねん。これまでは、この先進技術にアクセスできるんは、ソフトウェア開発者とか研究者とか、その分野の専門家っていう限られた人たちだけやったんよ。でも最近の発展で、強力なツールが一般にも使えるようになってきてん。生成AIツールやモデル、特に大規模言語モデルが一般公開されたことで、すでに仕事のやり方がかなり変わってきてんねん。今後もエージェント型AIの発展で、この流れはもっと加速するやろな(Acharya et al., 2025; Singh et al., 2024)。こういう進歩によってAIの利用が民主化されて、これまでにない能力が大衆の手に届くようになったんやけど、文脈に敏感で専門的な応用においてはまだギャップがあんねん。今の生成モデルは全体的には効果的やけど、特定のタスクに必要な深い専門知識を提供するには物足りんことが多いんよ(Kumar et al., 2023; Mukherjee & Chang, 2023; Piller et al., 2024; Sharma et al., 2023)。

知識労働っていうのはな、生成AIが広く普及することで一番影響を受ける分野やと考えられてんねん。知識労働における生成AI導入の影響はポジティブやと思われてて、認知的な負担の軽減、より複雑なタスクへの対応力向上、学習プロセスの強化なんかがメリットとして挙げられてるで(Alavi & Westerman, 2023)。知識労働はGAEsの応用可能性がほぼ無限にあるから、この生成型人工エキスパートの概念化はその領域に基づいてんねん。さらに、人間とAIのパートナーシップは知識労働を強化する要因になるんや(Jarrahi, 2018)。

こういう状況があるから、知識労働における文脈に応じた知性への需要増加に対応するために特別に設計された、新しいタイプのAIシステムを開発するチャンスがあるわけや。こういうシステムは、既存の生成AIシステムよりも生産性に貢献できる可能性があんねん。このギャップを埋めるために、ワイらは生成型人工エキスパート(GAEs)っていうコンセプトを開発して提案してんねん。

© 2025 著者ら。AI Access Foundationにより、クリエイティブ・コモンズ表示ライセンス CC BY 4.0の下で出版。

---

## Page 2

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p002.png)

### 和訳

SOWA & PRZEGALINSKA

生成人工エキスパート(GAEs)ってのは、コンピュータシステムの新しいカテゴリやねん。会話できるインターフェースを持ってて、生成AIをベースにしとって、専門知識を搭載して、人間と一緒に協力しながら問題を解決する、っていう仕組みなんや。半自律型で、めっちゃ専門特化したAIエージェントとして動くんやで(Poole & Mackworth, 2023)。GAEsは狭いけど深い知識を持ってて、特定の分野に絞り込んで、そのユースケースにぴったり合うようになっとる。他のLLMベースのシステムと同じように、世界についての一般的な知識や理解は持っとるんやけど、GAEsの基盤となるモデルは、特定ドメイン用のトレーニングデータで訓練されとって、そのドメインに適した方法で具体的な問題を解決できるようになっとるんや。GAEsは知識労働のあらゆる分野に応用できるって想像してみてや。地元の税務アドバイス、医療サポート、研究室での遺伝子シーケンシングの手助けとか、なんでもありや。GAEsは専門家も非専門家も、知識労働でサポートできるんやで。GAEsを使う感覚は、今あるLLMベースの会話システムを使うのとかなり似とる。GAEsは特定のペルソナを担当することもできんねん。例えば、あるトピックで何百本も論文出しとるベテラン大学教授とか、成功した起業家とかな。ほんで、そのペルソナに合ったコミュニケーションスタイルや全体的な態度を採用するわけや。GAEsの設計にペルソナを入れるのは、初期の研究結果で正当化されとって、なんでかっていうと、人間っぽい特徴を持つボットの方が、そうでないボットより好まれるユーザーがおるって分かったからやねん。ペルソナの性格特性は、ユーザーの好みにめっちゃ依存しとる(Pal et al., 2023; Sowa et al., 2021)。GAEsはマルチモーダルな生成AIソフトウェアをベースにしてて、システムの土台として大規模言語モデルがあるんや。つまり、自然言語処理、推論、学習、画像処理、コンテンツ生成といった能力を持っとるってことやね。せやから、ユーザー(人間)とのコミュニケーションインターフェースは自然言語—書き言葉でも話し言葉でもOKや。これらのシステムは推論して意思決定もできるんやけど、それは限定的な範囲で、人間の監視付きでな(後で説明する「制限付き自律性」ってやつや)。あと重要なんは、GAEsは専門分野における人間の専門知識を置き換えるもんやなくて、サポートするためのもんやってことやで。

今の生成AIシステムは、汎用性はあるけど、知識ベースが広くて浅いのが普通やから、ドメイン特化のタスクを扱うときに不正確になりがち、つまり「ハルシネーション」っていう嘘をついちゃう問題があるんや(Roychowdhury, 2023)。ユーザーのプロンプト頼みの受け身な性質とか、ワークフローに統合する能力が限られとるせいで、効果が制限されることも多いんやな。でもな、生成AIの技術進歩のおかげで、新しいシステムは従来のエキスパートシステムよりも「人間の専門知識をエミュレートする」(Jackson, 1999)っていう約束に近づいてきとるんや。この論文は、文献のギャップに対処するために、生成人工エキスパートっていう新しい概念を紹介しとる。これは複数の先進的な特性をユニークに組み合わせて、現行の生成AIシステムで観察される限界に対処するシステムやねん。わしらの研究の特徴は、全体論的なアプローチにあって、これらの特性を体系的に統合したフレームワークを作って、専門的な知識労働の現場でAIの適用可能性を高めとるところやで。

この論文は、生成AI、エキスパートシステム、人間とAIの協働など、複数の領域にわたる文献レビューに基づいた概念分析を採用しとる。アブダクション推論(最もらしい説明を導き出す推論法やな)を使って、現行の生成AIシステムで特定された限界に対処する新しい概念を提案しとるんや。

最初のセクションでは、エキスパートシステムとそのGAEsにとっての基本的な役割について説明するで。その後、生成人工知能について議論する。この2つの概念を合わせることで、エキスパートシステムから生成人工エキスパートへの飛躍に貢献するんや。第2セクションでは、GAEsのさらなる理論的基盤を提供する—人間とAIの協働に関する増え続ける知識体系やな。第3セクションはGAEsの定義に焦点を当てとる。概念を詳しく定義して、他のタイプの生成AIシステムと区別する7つの定義的特性を提示するで。ほんで、GAEsがどう動くかの具体例を示して、既存の技術を使ってGAEsを開発するための実践的な手順も説明するわ。第4セクションでは、GAEsの影響と、その開発に関連する懸念や課題について議論するで。

2102

---

## Page 3

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p003.png)

### 和訳

# エキスパートシステムと生成AIから生成人工エキスパート(GAE)へ

このセクションではな、生成人工エキスパートの土台となるエキスパートシステムと生成AIについて話していくで。エキスパートシステムってなんやねんってとこを簡単に説明して、その限界についても触れるわ。ほんで、生成AIがどんどん重要になってきとる話と、GAEへの大きな飛躍の可能性についても見ていくで。

生成人工エキスパートってのは、エキスパートシステムが進化したもんやと思ってもらってええねんけど、その能力と可能性はめっちゃ桁違いやねん。エキスパートシステムってのは、人間の専門知識をコンピュータの中に詰め込んで再現しようとした最初の本格的な試みやったんよ。そういう意味では、エキスパートシステムの研究が生成人工エキスパートの誕生への土台を作ったわけやな。エキスパートシステムはAI発展の重要なステップやったんやけど、1970年代とかその後の時代では、コンピュータの処理能力が足りんかったり、技術的な問題がいろいろあったりして、なかなか実用化されへんかったんよ(Crevier, 1993; Partridge, 1987)。

## 2.1 エキスパートシステム

エキスパートシステムってのは、人間の専門家の意思決定能力を真似することで、複雑な問題を解決するために作られたAIアプリケーションのことやねん。このシステムの本質はな、めっちゃ大量の情報を統合して、蓄えた知識を使って推論して、人間の専門家みたいに専門的な見解を出せるところにあるんよ(Giarratano & Riley, 2005)。エキスパートシステムはいろんな分野で使われてきてな、例えばデータ解釈タスク(地震分析とか言語処理の意味解析とか)、予測タスク(天気予報とか)、医療タスク(診断支援とか)なんかがあるで(Hayes-Roth et al., 1983)。

エキスパートシステムの基礎は1960年代から70年代に築かれたんや。先駆的なプロジェクトとしてはな、化学構造を推定するためのDENDRAL(Lindsay et al., 1993)とか、医療診断に特化したMYCIN(Shortliffe, 1974)とかがあったんよ。これらの試みで、ルールベースのシステムが特定の専門分野で人間の意思決定を真似できる可能性が示されたんやな。その後の数十年、特に1980年代には研究と商業的な関心がめっちゃ高まって、SIDみたいなLISPで書かれた商用エキスパートシステムが実際に導入されるようになったんや。20世紀終わりから21世紀初めにかけては、エキスパートシステムはもっと高度な計算技術と統合されていったで。ニューラルネットワークとルールベースシステムの力を組み合わせることで、エキスパートシステムの能力と適応性はかなり上がったんよ(Yoon et al., 1994)。

エキスパートシステムはいくつかの部品が繋がってできとるねん。コアになるのが「知識ベース」で、ここに専門的な情報とルールが保存されとる。「推論エンジン」は論理的なルールを使って知識ベースから答えを導き出すんや。「説明機能」はシステムの推論と意思決定のプロセスを見えるようにしてくれる。「知識獲得機能」は人間の専門家から専門知識を集めて、エキスパートシステムが使える形式に変換するプロセスを効率化するもんや。ほんで「ユーザーインターフェース」は人間とエキスパートシステムの橋渡し役で、効率的なやり取りができるようにして、ユーザーが簡単に質問を入力してシステムの回答を理解できるようにするんよ(Giarratano & Riley, 2005; Waterman, 1985)。

従来のエキスパートシステムにはいくつかの限界があってな。まず「知識獲得のボトルネック」っていう大きな課題があったんや。なんでかっていうと、このプロセスはめっちゃ手間がかかって、人間の専門家による手作業での入力と整理が必要やったからや。知識ベースを構築して、更新して、拡張するのにめっちゃ時間とお金がかかって、システムを最新かつ実用的な状態に保つのがほんまに難しかったんよ(Chu & Hwang, 2008; Hubert & Dreyfus, 1997)。性能も初期のエキスパートシステムの課題やったで。これはコードを事前にコンパイルせんと解釈するツールを使っとったことが原因やったりしたんや。知識ベースのサイズと複雑さが増すにつれて、計算の負荷も増えて、単純なタスクでさえ計算コストがめっちゃ高くついたんよ。

---

## Page 4

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p004.png)

### 和訳

SOWA & PRZEGALINSKA

(Partridge, 1987)。エキスパートシステムってな、限られた固定された知識の世界の中でしか動かれへんかってん(だいたい特定の学問分野だけに限定されとった)。概念とか概念同士のつながりを理解する力がなかったんよ。この制限のせいで、システムは新しい洞察を生み出したり、知識ベースの中の違う要素同士のつながりを理解したりすることができへんかったんやな(McCarthy, 1984)。

2.2 生成人工知能

生成人工知能っていうのは、既存のデータから学んだパターンをもとにして、テキストとか画像とか音声とか、新しいデータを作り出すように設計されたAIシステムのカテゴリーのことやねん(Goodfellow et al., 2016)。この技術が重要視され始めたのは2017年から2018年頃で、最初のトランスフォーマーベースのシステムが開発されてからやな。その後、2019年から2021年にかけてさらに注目されるようになって、でも生成AIの応用可能性と開発のピークは今まさに進行中やねん。

めっちゃ有名な開発成果としては、大規模言語モデルがあるで。OpenAIのGPT-1からGPT-4、Meta AIのLLaMA、GoogleのGeminiモデル、それからAnthropicのClaudeモデルとかな。大規模言語モデルは、めっちゃ膨大なテキストデータセットに対する統計的パターン認識の原理で動いとるんよ。モデルの訓練段階で、テキストデータの中の言語構造と確率的な依存関係を認識するねん。ほんで、プロンプト(指示文)を受け取ったら、この知識体系をもとにして、人間みたいなテキスト出力を生成するんよ。これらのモデルには認知能力がないねん。つまり、人間の認知みたいに受け取ったテキストの意味を理解してるわけやなくて、以前学んだパターンに基づいて次のテキスト要素を予測しとるだけなんよ(Janik, 2023)。一方で、これらのシステムが訓練されたナレッジベースはめっちゃ膨大やったから、取り出したり生成したりできる情報の範囲もめちゃくちゃ広くて、いろんな面で人間の専門家にほんまに説得力あるくらい似てるんよ(Z. Wang et al., 2022)。開発と応用においてはまだ若いけど、LLMはすでにビジネスにとってめっちゃ価値があるものと見なされてて、翻訳とか要約とか質問応答みたいなタスクを助けてくれるんやで(Brown et al., 2020)。

生成システムは画像生成においてもすごい能力を発揮するんよ。深層生成ニューラルネットワークに基づいていて、拡散モデルっていうのを使っとるねん(Chang et al., 2023)。なんでかっていうと、これらの手法がめっちゃ発展したおかげで、Stable DiffusionとかMidjourneyとかDALL-Eみたいなシステムが、テキストの説明文(プロンプト)をもとに高品質な画像を生成できるようになったんよ。

ソフトウェア開発の分野では、GitHub Copilotみたいなシステムが、PythonとかJavaScriptとかCとか人気のプログラミング言語でコードを理解して生成できるようになっとるで(Yetistiren et al., 2022)。音声生成でもめっちゃ進歩があって(Borsos et al., 2023)、動画を生成しようという試みも進行中やねん(Liu et al., 2024)。最後に、マルチモーダル生成AI(Suzuki & Matsuo, 2022)っていうのがあって、これはテキストとか画像とか動画みたいな異なるデータの種類を組み合わせるもので、応用の可能性がめっちゃでかい新興分野やねん。いろんな出力タイプを統合することで、これらのモデルはもっと複雑で多用途なアプリケーションを可能にするんよ。

生成AIはGAE(生成人工エキスパート)の基盤やねん。GAEのマルチモーダル能力、つまり自然言語処理とか画像生成とかコード生成は、生成AIの進歩の直接的な拡張であって、GAEがその場のタスクにとって一番効果的な方法でやりとりしたり応答したりできるようにしてくれるんよ。

2.3 エキスパートシステムから生成人工エキスパートへ

生成人工エキスパートは、エキスパートシステムからの技術的な大飛躍やねん。この進歩は、人間の専門知識を模倣するっていう共通の目標に根ざしていて、生成人工知能の進歩がこの大きな技術的飛躍の原因になっとるんよ。

2104

---

## Page 5

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p005.png)

### 和訳

# エキスパートシステムから生成型人工エキスパートへ:知識労働における人間とAIの新しいコラボレーションの形

「生成型人工エキスパート」の「エキスパート」っていう言葉な、これ実は「エキスパートシステム」の「エキスパート」を直接引き継いで発展させたもんやねん。生成型人工エキスパートに進化する中で、専門的な能力っていう考え方はそのまま残しつつ、もっと幅広いことができるようになってんねん。この進化はな、単にAI技術が進歩しましたっていう話だけやなくて、学習できる、適応できる、そして何よりも大事なんが、昔ながらの固定されたルールベースの推論を超えて、新しい知見を自分で生み出せるシステムへの移行を表してんねん。せやから、名前自体はエキスパートシステムの伝統を受け継いでるけど、同時にもっと洗練されたシステムへの転換点でもあって、人間の専門知識を単に真似するんやなくて、サポートすることを目指してんねん。

生成型人工エキスパートの「専門性」を定義する時な、エキスパートシステムに関するしっかりした先行研究を参考にしてるねん。Giarratano と Riley(2005)によるとな、エキスパートシステムっていうのは専門知識を使って人間のエキスパートと同じレベルで問題を解決するシステムのことで、「エキスパートとは、ある分野で専門知識を持っている人のこと」やねん。最初のエキスパートシステムは専門家の知識だけを基に作られてたんやけど、時間が経つにつれてそれが緩和されて、明示的に体系化された知識を基にしたエキスパートシステムも増えていったんや。Giarratano と Riley は階層構造を提唱してて、ほんまの専門知識——これは希少で一つの分野に特化したもんやけど——これは一般的に手に入る知識よりも上位に位置づけられてんねん。ただし、エキスパートシステムがちゃんと機能するには両方が必要やっていうてるわ。著者らはさらにこうも言うてるねん:「エキスパートシステムは、人間のエキスパートと同様に、一般的に一つの問題領域のエキスパートとして設計される」、そして「エキスパートシステムは、人間のエキスパートが問題の解決策を推論したり推測したりするのと同じ方法で推論や推測を行う」って。この「エキスパート」の概念の理解が、生成型人工エキスパートに関するさらなる研究に直接つながっていくわけや。

エキスパートシステムはな、画期的やったんやけど、根本的にはガチガチのルールベースの枠組みに縛られてて、新しい状況や予想外の事態に適応する能力が限られてたんや。その結果、複雑な環境ではエラーを起こしやすい動作になりがちやったんよ。これらのシステムは、動的な環境では当たり前の継続的なフィードバックループから切り離されてて、適用分野の変化する状況に合わせて進化する能力がなかったから、外部のパラメータが変わった途端に時代遅れになってしまってたんや。エキスパートシステムはスケーラビリティの面でもめっちゃ大きな問題を抱えてたんや。知識ベースは自動的に拡張できへんかったから、学習したり更新したりするのに大がかりな手作業が必要やってん。これは現代の生成型AIが持つ自己改善能力とはえらい違いやな。さらに、エキスパートシステムには協調能力や創造的な能力がなかったから、学際的な問題解決や創造的な課題には使いにくかったんや。これはまさに生成型人工エキスパートが設計上得意とする領域で、継続的なやり取りと生成能力を活用してるからこそできることやねん。

エキスパートシステムは、AIが専門分野で人間の意思決定を模倣できることを示すことで、生成型人工エキスパートの基礎を築いたんや。専門知識を一連のルールベースの操作にまとめることで、これらのシステムは人間のエキスパートみたいに相談に乗ったり推奨を出したりできたんやな。ただな、この模倣は特定の狭く定義された問題空間に限られることが多くて、新しいデータから学んだり、変化する状況に適応したりする能力はなかったんや。生成型人工エキスパートは生成型AIの進歩を活用してて、多様なデータ形式を処理・生成する能力があるから、専門分野でもっと複雑な役割を果たせるようになってんねん。さらにな、生成型AIベースのシステムは問題解決に創造性という要素を持ち込めるんや——新しい解決策やアイデア、知見を生み出せるってことやな(Rick ら、2023)。新しい計算手法とより高い処理能力のおかげで、より大規模なタスクも扱えるようになってるし。そして何よりも、生成型人工エキスパートは単独で意思決定するだけのもんやなくて、人間の能力を高める協働ツールなんやで。

## 3. 生成型人工エキスパートを可能にする人間とAIのコラボレーション

このセクションではな、人間とAIのコラボレーションという概念の継続的な発展が、どうやって生成型人工エキスパートの登場の土台を作ってるかを説明するで。ただその前に、サブセクション2.1で、ビジネスの文脈におけるコラボレーションに関する厳選された理論と実証的エビデンスを整理するわ。これが人間とAIのコラボレーションという概念を裏付ける6つの理論的根拠のセットになってんねん。

---

## Page 6

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p006.png)

### 和訳

SOWAさんとPRZEGALINSKAさんの研究やねんけどな

わし らが言いたいのは、「コラボレーション」っていう概念をちゃんと理解することが、人間とAIが一緒に仕事するってことを考える上でめっちゃ大事やねんってことやねん。ほんで、その先にある「生成的人工エキスパート」ってやつを作るためにも欠かせへんねん。コラボレーションって、定義上は人間同士の間で起こるもんやねんけど(アメリカ心理学会、2024年)、わしらは「人間同士のコラボの知識って、人間とAIエージェントのコラボにも使えるんちゃう?」って主張してんねん。

**3.1 ビジネスにおけるコラボレーション - 理論編**

コラボレーションってのは、ビジネスの世界でめっちゃ重要な要素やねん。なんでかっていうと、個人や組織の間で知識とかリソースとかスキルを共有するのを促進するからやねん。コラボすることで、企業は成長とかイノベーションの新しいチャンスをゲットできるようになるわけや(JassawallaとSashittal、2006年)。ここからは、人間とAIのコラボレーション、ほんで生成的人工エキスパートがコラボシステムとして登場することを支持する6つの理論的な根拠を紹介するで。これらの理論がどないしてこのコンセプトの発展に役立つかも説明するわな。

**3.1.1 コラボレーションは人間にとって自然なもんやねん**

コラボレーションって、進化の力から生まれたメカニズムやから、人間にとってはめっちゃ自然なことやねん(Hill、2002年)。グループの中で人々がお互いに頼り合うことで、コラボに基づいた文化的な慣習やルールが発展してきてん。これがわしら人類を「生まれつきコラボする生き物」として他の種と区別してるわけや(Tomaselloら、2012年)。せやから、人間とAIのコラボも、こういう自然な傾向から生まれてくる可能性があるねん(JemielniakとPrzegalinska、2020年)。結果として、人間同士がコラボするときのメリットって、人間とAIエージェントがコラボするときにも当てはまるかもしれへんねん。競争するより協力した方がええってことやな(Sowaら、2021年)。人間同士のコラボについての理解はめっちゃ深いから、これが人間とAIのコラボを考えるときの基礎になるべきやねん。ほんで、人間がコラボに向いてるっていう自然な傾向は、GAEs(生成的人工エキスパート)にとっても基本的なことやねん。GAEsは人間と一緒にコラボして働くように設計されてるからな。

**3.1.2 社会的交換理論のもとで、人間はコラボのコスト・ベネフィット分析をやるねん**

社会的交換理論(アメリカ心理学会、2018年)っていうのは、人間が何かのやり取りをするときに、得すること と損することを天秤にかけて判断するっていう話やねん。これがGAEsの場合にもめっちゃ当てはまるねん。ユーザーは、生産性が上がるとか意思決定がよくなるとかいうメリットがコストを上回ったら、GAEsをもっと使うようになるわけや。この理論は、コラボの場面でちゃんと具体的な価値を提供できるようにGAEsを設計することが大事やって教えてくれてるねん。

**3.1.3 社会的相互依存理論のもとで、コラボは競争より優れてるねん**

社会的相互依存理論っていうのは、ある状況では協力(コラボ)した方が競争するより、ええ結果が出るっていうことを直接支持する理論的な枠組みやねん(Deutsch、1949年;JohnsonとJohnson、1989年)。この理論によると、グループ内で目標がどう設定されてるかによって、そのグループの結果がめっちゃ変わってくるねん。協力的(コラボ的)な目標設定の方が、競争的とか個人主義的な構造よりも、ポジティブな結果につながりやすいってことや。ポジティブな相互依存っていうのは、一緒に働いてる人らが目標を一緒に達成できる状態のことやねん。競争してたら、お互いを出し抜こうとしてリソースを無駄遣いしてまうやろ?でもコラボやったら、共通の目標のためにリソースを共有するから、長い目で見たらめっちゃ生産的になるねん。さらに、コラボは感情的な満足感とか仲間意識も与えてくれるねん。個人やグループがコラボすると、「みんなで同じ目的に向かってる」とか「一緒に達成した」っていう感覚が得られて、それが心の報酬になるわけや(NowakとHighfield、2011年)。競争よりコラボの方が価値があるっていうのは、GAEsの設計にも反映されてるねん。これらのシステムは、人間とコラボして、共通の目標のためにリソースや専門知識を共有するように開発されてるから、全体的な

2106

---

## Page 7

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p007.png)

### 和訳

# エキスパートシステムから生成的人工知能エキスパートへ:知識労働における人とAIのコラボレーションの新しいコンセプト

生産性をガツンと上げてイノベーションをバンバン生み出すってなると、競争するよりもコラボするほうがめっちゃ効果的やねん。

## 3.1.4 CPMモデルがGAEの設計に役立つ話

**コラボレーション・プロセス・モデル(CPM)**っていうのは、コラボの複雑さを分析して理解するための枠組みやねん(マテシッチとモンジーさんが1992年に作ったやつな)。このモデルによると、コラボがうまくいくかどうかを左右する要因が19個もあるらしいわ。本来は全部の要因を同時に管理せなあかんのやけど、この論文では特に大事な3つをピックアップするで。

**(1)お互いを尊重して、理解して、信頼し合うこと** - コラボってのは、相手の専門知識を認めて価値あるもんやと思えたとき、もっと言うたら信頼し合えたときにめっちゃうまくいくねん。そうすると、オープンにコミュニケーションできる環境ができて、お互いを頼りにできるようになるわけや。

**(2)役割と方針をハッキリさせること** - 誰が何をするか、何を期待されてるかをビシッと決めとくことで、みんなが自分の役割とルールをちゃんと理解できるようになるねん。

**(3)意思決定を複数のレベルで行うこと** - コラボの中で意思決定の権限を色んなレベルに分けとくと、問題解決とか意思決定がもっと繊細で柔軟にできるようになって、結果的にコラボの効果がグンと上がるんやで。

なんでこれが大事かっていうと、CPMのこの3つの要因 — お互いの尊重、明確な役割、複数レベルの意思決定 — は、GAE(生成的人工知能エキスパート)を設計するときにも反映せなあかんからや。つまり、GAEは人間の専門知識をリスペクトして、自分の機能をハッキリ持っていて、コラボの場面で色んな自律性のレベルで(ちゃんと範囲を決めた上で)意思決定できるように作らなあかんってことやな。

## 3.1.5 コラボがイノベーションと知識の移転を促進する話

ビジネスでのコラボって、カジュアルな知識共有から、もっとガッチリしたパートナーシップやアライアンスまで、いろんな形があるねん。例えば、部門横断型のチームは、お互いの専門知識やリソースを交換することでめっちゃメリットがあるで(ジャサワラとサシタルさんが2006年に言うてたわ)。組織間のコラボも、会社の業績にプラスの影響があるって研究で分かってるねん(カオとチャンさん、2011年)。他にも、イノベーションが増える、製品の品質が上がる、場合によってはコストも削減できる、みたいなええことがいっぱいあるわけや。

ほんで、組織間で知識をうまく移転するのに影響する要因は、個人同士のコラボを考えるときにもそのまま当てはまるねん。コラボとか知識移転のコンセプトは、そこでも同じように使えるからな。コラボに参加することで、個人は知識を広げられるし、スキルを磨けるし、問題解決能力も上がって、結局は自分の成長につながるんやで(野中さんと竹内さんが1995年に言うてたやつな)。GAEは色んな分野に入り込んで人間の専門家と一緒に働くことで、知識の共有を促進して、革新的なソリューションを生み出すことに貢献するねん。コラボ環境にある多様な視点と専門知識から、めっちゃ恩恵を受けられるわけや。

## 3.1.6 コラボが生産性を向上させる話

コラボは起業家にとってほんまに大事やねん。特にイノベーションを育てたり、多様なスキルを活かして効率を上げるためにな。コラボに参加することで、起業家は他の人たちの「集合知」を活用できるようになって、新しいアイデアを生み出したり、革新的なソリューションを作れるようになるんや。

広くて多様なネットワークを持ってる起業家は、限られた同質的なネットワークしか持ってない起業家よりも、質の高いイノベーションのアイデアを生み出せるって研究で分かってるで。積極的に多様なネットワークのつながりを探して活用してコラボすることで、起業家はイノベーション能力を高められるってことやな(ビョルクとマグヌッソンさん、2009年)。

インダストリー4.0(第四次産業革命ってやつな)では、会社がちゃんとしたコラボの実践をすれば、コラボが生産性向上の起爆剤になるねん(シューさんたち、2014年)。ほんで、テクノロジーも加わると、コラボと技術と生産性の間に相互依存の関係があるって分かってるで(サンダースさん、2007年)。

同じように、個人の従業員や起業家のレベルでも、テクノロジー(この場合はSNSやな)がプロフェッショナル同士のコラボを増やして、結果として生産性が上がることが分かってるねん(フェレイラとドゥさん、2009年)。

ただし注意が必要やで!コラボが生産性にプラスの効果があるってのはみんなの意見が一致してるけど、**コラボのやりすぎ**は逆効果になることもあるって話もあるからな(ランスマンとクラインさん、2018年)。コラボ疲れってやつや。何事もほどほどが大事やな!

---

## Page 8

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p008.png)

### 和訳

SOWAとPRZEGALINSKAの話な

3.2 人間とAIのコラボレーション(HAIC)

人間とAIのコラボレーションってまだ新しい分野やねんけど、これについての学術論文がめっちゃ増えてきてんねん(Hemmerらが2023年に言うてる)。まずステップ1として人間とコンピュータのやり取り(HCI)の話からして、ほんでステップ2で人間とAIのやり取り、ほんでステップ3で人間とAIのコラボレーションっていう順番で見ていこか。生成AI系のエキスパートシステムっていう概念とか、それを知識労働に使うっていう話は、根本的にこの人間とAIのコラボレーションが土台になってんねん。

3.2.1 人間とコンピュータのやり取りから人間とAIのコラボレーションへ

人間とコンピュータのやり取り(HCI)っていうのは、もうしっかり確立された研究分野でな、人間とテクノロジーの間のやり取りを研究してんねん。昔からコンピュータのインターフェースをどう設計して評価するかっていうことをやってきたわけや。使いやすさとか、体への負担の少なさとか、ユーザーが気持ちよく使えるかとか、そういうことを重視してんねん。この分野は始まってからめっちゃ進化してきて、心理学とかデザインとか社会科学とか、いろんな分野をまたいで研究するようになってん(Kimが2015年に書いてる)。その結果、ハードもソフトもどんどん洗練されたインターフェースができてきて、ユーザーがコンピュータとやり取りしやすくなってきてんねん。例えば自然言語処理を使ったインターフェース、チャットボットとか音声アシスタントとかな。ボタンポチポチとかスライダーいじるんやなくて、普通に話しかけて自分がやりたいことをマシンに伝えられるっていうやつや。

AIが進歩して自然言語でのやり取りの質がめっちゃ上がってきたもんやから、「人間とAIのやり取り」っていう新しい概念が生まれてきたんや。人間とAIのやり取りは従来のHCIの基本原則を全部踏襲した上で、AIベースのシステムならではの特性に合わせた新しいガイドラインも追加されてんねん(Amershiらが2019年に言うてる)。

言葉を使うのは人間にとって自然なことやし、誰かと協力して何かやるのも自然なことやねん(Hillが2002年に言うてる)。人間とAIの間で質の高い自然言語でのやり取りができるようになったら、その二者が協力し合うっていうのは十分あり得る話で、当然の次のステップなんや。今までの人間とAIのやり取りって、質問したり命令したりの単純な往復やったやん?そこから一歩進んで、人間もAIエージェントもお互いに適応して、やり取りから学び合うっていう新しい領域に入っていくわけや。単純なやり取りっていうのは一方的やったり取引的やったりするねん。人間が何か欲しい(情報とか、タスクを解決してほしいとか)から、AIに聞くっていう感じや。一方でコラボレーションっていうのは、もっとお互いに利益がある関係やねん。つまり両方が同じゴールに向かって一緒に働くっていうことや。

あと、人間がAIと協力したくなる理由の一つに、人間はどんなやり取りでも自分にとっての利益を求めるっていう傾向があんねん(社会的交換理論っていうやつな)。やからAIとのコラボレーションは人間にいろんなメリットをもたらす可能性があって、実験で既に証明されてるものもあんねん(生産性が上がるとか、特定のタスクを自動化できるとか)。まだ研究されてへんメリットもいっぱいあるで(Camperoらが2022年に言うてる)。

「協働知性」っていうのも、人間とAIのコラボレーションが理にかなってるっていうことを裏付ける理論的な概念やねん。昔は、テクノロジーを道具として使いながら、人間同士がネットワークを作って共通の問題を解決するっていう意味やったんやけど、今ではAIもその「複数のエージェントが問題を解決するネットワーク」の一員になれるっていうことが分かってきてんねん。人間と手を取り合って働けるっちゅうことや(Gillが2012年に言うてる)。DaughertyとWilson(2018年)は本の中でこの考えをめっちゃ詳しく論じてて、職場で人間がAIに置き換えられるっていうよりは、AIベースのシステムと一緒に働くようになる可能性の方が高いって主張してんねん。もう一つ、この分野への大きな貢献はThomas Maloneの「Superminds」(2018年)やな。人間とコンピュータが一緒に考えて問題を解決できる可能性を示してんねん。彼はそういうコラボレーションの中でマシンが人間に対して取れる役割を4つに分けてんねん。「道具」「アシスタント」「同僚」「マネージャー」や。全部ユーザーに価値を提供するし、チームのパフォーマンスも上げてくれるんやけど、そのレベルはそれぞれ違うねん。

---

## Page 9

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p009.png)

### 和訳

エキスパートシステムから生成型人工エキスパートへ:知識労働における人間とAIの協働に関する新しいコンセプト

近さっていうのがあるねんな。「道具」やと、やりとりは一方通行で、いっつも人間から始めなあかんねん。「アシスタント」はもうちょい自律的に動けるんやけど、まあ限界はあって、道具と同じく、やることは全部人間がコントロールしてるねん。「仲間」になると自律性がもっと上がって、少なくとも人間の監督下では動くんやけど、ユーザーとも他の関係者ともスムーズにやりとりできるようになるねん。「マネージャー」になったら、人間とAIが混ざったチームの仕事を振り分けたり管理したりできるようになるかもしれへんねん。マローンはな、人間と機械が一緒に働くのは集合知の一例やって言うてんねん。AIはデータ収集とかパターン認識とか分析みたいなタスクを担当できて、人間は感情的知性とか共感とか抽象的思考とか倫理的な判断が必要な仕事を担当できるねん。こういう分業をすることで、両方の強みを最大限に活かせて、別々に働くよりもっとええ結果が出せるっちゅうわけや。マローンが言うてるように、どっちか一方だけでは達成できへん成果を出すために、こういうコラボがイノベーションを推進する役割がめっちゃ重要視されてんねん。AIが人間と一緒に問題解決ネットワークの一部になるっていう協調知性のコンセプトは、GAEs(生成型人工エキスパート)のアイデアの中核やねん。GAEsはな、こういうネットワークの中でアシスタントとか仲間とか、場合によってはマネージャーとして機能するように設計されてて、データ処理や分析能力で人間の知性を補完して、個人の能力を超える集合知に貢献するねん。

ワンらの研究(2020)では、人間とAIの単なるやりとりからほんまのコラボレーションへと焦点を移すべきやって提唱してて、お互いの目標理解とタスクの共同管理を強化するためのコンピュータ支援協調作業のフレームワークを提案してるねん。デラーマンらの研究(2021)では、人間の知性と人工知能を組み合わせた社会技術的アンサンブルが必要やって特定してて、ハイブリッド知能を通じて複雑な目標を達成できるシステムの開発を導くための構造化された設計分類法を提供してんねん。ナーとジェン(2023)は、ビジネスとかヘルスケアとか教育とか、いろんな分野で生成AIがもたらす変革の可能性を強調してて、倫理的・技術的・規制的な課題に対処するために人間中心のアプローチが必要やって言うてんねん。最後に、メメルト(2023)は、ブレインストーミングタスクにおける人間とAIのコラボレーションのダイナミクスを探ってて、GPT-3みたいな生成型大規模言語モデルは認知プロセスを刺激できる一方で、フリーライディング(ただ乗り)みたいなリスクもあることを明らかにしてて、従来の人間グループの場にAIを統合することの複雑さを浮き彫りにしてるねん。この一連の文献は、人間とAIのやりとりの変化していく状況を示してて、生成型人工エキスパートを導入するための土台を築いてんねん。

3.2.2 人間とAIのコラボレーションの事例

知識労働における人間同士のコラボが様々な形を取れるように、人間とAIのコラボもいろんな形があんねん。いくつかの例で示されてるように。最近この分野の文献がめっちゃ増えてて、人間とAIのコラボの多彩な応用分野を示すケーススタディがいっぱいあんねん。

実験研究では、マーケティング分野での人間とAIのコラボレーションが、人が一人で働くよりも生産性と仕事の満足度の面でええ結果をもたらすって証明されてんねん(ソワ&プジェガリンスカ、2020)。知識労働での他の例としては、組織内で専門知識を広めたり新入社員をトレーニングしたりするのにHAIC(人間とAIのコラボレーション)を使う可能性があんねん(シュピッツァーら、2022)。ワンら(2023)は、データサイエンスの仕事にHAICを使う事例を紹介してんねん。人間のワーカーとAIが一緒に問題を解決して、タスクを何回も受け渡しするプロセスを実演してんねん。まず人間がデータ分析の下準備をして、キーとなるデータポイントと適切な可視化レイアウトを選んで、次にAIシステムが分析を実行してスライドを作成すんねん。その後、人間が結果を評価して、改良やカスタマイズを提案して、それをAIシステムが処理するっちゅう流れやねん。

ヘルスケア分野でのHAICにはほんまに強い根拠があって、有資格スタッフの不足問題に対処したり、専門家の生産性を上げたり、患者ケア全体に利益をもたらせる可能性があんねん。意思決定の透明性みたいに対処せなあかん課題はいっぱいあるんやけどな。

---

## Page 10

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p010.png)

### 和訳

SOWA & PRZEGALINSKA

バイアスとかデータのセキュリティとか、まだまだ研究が必要なとこあんねん(Lai et al., 2021)。医療の意思決定で人間とAIがどうコラボしたら一番ええか、まだベストな形は見つかってへんねんけど、これが出てきたこと自体は患者さんにとってめっちゃええことやで。大腸内視鏡のビデオを分析する実験でな、「人間とAIのハイブリッドチーム」が、人間だけとかAIだけでやるより圧倒的にええ結果出したんや(Reverberi et al., 2022)。

リアルの世界でもな、トラックの運転手がルート計画するときにAIアシスタントと組んだら、めっちゃ効率上がることが証明されてん。この場合、ベテランドライバーやったとしても、人間だけより人間とAIのチームのほうがええ結果出したんやで(Loske & Klumpp, 2021)。あと分かりやすい例で言うたら、コボットってやつがあんねん。これは協働ロボットって言って、工場で人間と「手に手を取って」複雑な作業を一緒にこなすやつやな(Colgate et al., 2023)。Saffiotti et al.(2020)は、アートや音楽パフォーマンスでの人間とAIのコラボモデルを提案してんねん。人間のピアニストとAIドラマーとか、人間のダンサーとAIドラマーとか、人間のピアニストとロボットダンサーの組み合わせやな。

こういう例見てたら、人間とAIのコラボがいろんな分野でどんだけ可能性あるかよう分かるやろ?生産性上がるし、意思決定もようなるし、複雑なタスクも人間だけやAIだけよりずっと上手くこなせるんや。応用範囲がめっちゃ広いってことは、この分野の研究続けることが大事やし、GAEsの使い道もほんまに幅広いってことを示してんねん。

4. 生成的人工エキスパートの詳細

このセクションではな、生成的人工エキスパート(GAEs)の定義を説明して、実際どんな感じで使えるかっていう具体的なイメージを伝えるで。前半ではGAEsの定義と、GAEsを特徴づける7つの要素を挙げるわ。後半ではGAEsの具体例を見せて、どう使えるか分かってもらって、既存の技術とGAEsがどう関係してるか議論すんねん。

4.1 生成的人工エキスパート - 定義

生成的人工エキスパートっていうのはな、特定の専門分野で人間とAIがコラボするために設計された協働型の生成AIエージェントのことやねん。GAEsはマルチモーダルな生成AI(テキストだけやなくて画像とか音声とかいろんな形式を扱えるやつな)をベースにしてて、行動を起こせて、制限付きの自律性の中で動いて、他にもいろんな特徴があって、人間と一緒に問題解決や意思決定のプロセスに積極的に参加すんねん。GAEsは生成AIの能力を、コラボ重視・人間の仕事を強化する方向で活用してんねん。こいつらは会話インターフェースでユーザーとやり取りするように設計されてて、エキスパートレベルの知識が必要な複雑で専門的なタスクを解決するのを的確にサポートしてくれるんや。このアプローチのおかげで、生成AIの部分がただ大きくてぼんやりしたシステムの一部でしかない他のAIシステムとは、GAEsは一線を画してるわけやな。

ChatGPTとかGeminiとかClaudeみたいな汎用的なLLMベースのシステムとGAEsの違いは何かっていうとな、特定の専門分野をめっちゃ深く理解してるってとこやねん。この専門性は、その分野に特化したデータとシナリオで訓練することで実現してんねん。あともう一つの違いは、ユーザーのワークフローの中で半自律的に動けて、ある程度の判断を自分でして、いろんなタスクを実行できるってとこや。

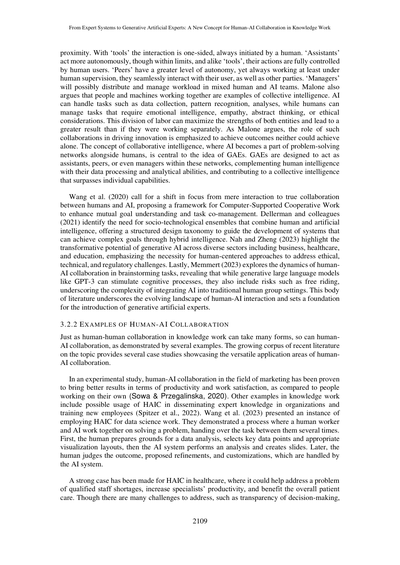

4.2 GAEsを特徴づける要素

GAEsを特徴づける要素っていうのは7+1個のリストになってて、この概念を詳しく理解するのと、他のAIベースのシステムと区別するためのもんやねん。この7つの要素が全部合わさって、この概念の定義になるわけや。これらの特徴は表1にまとめてあるで。GAEsとして認められるには、システムがこのリストの要素を全部満たす必要があんねん。既存のシステムでもGAEsっぽいやつ、つまりいくつかの要素は満たしてるけど全部ちゃうっていうやつは存在するかもしれへんな。

2110

---

## Page 11

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p011.png)

### 和訳

ほな、翻訳いくで〜!

---

全部の特徴を満たしてへんやつもあるねんけど、そういうシステムは「準GAE(擬似GAE)」って呼ぶことにするわ、GAE的な使い方するならな。

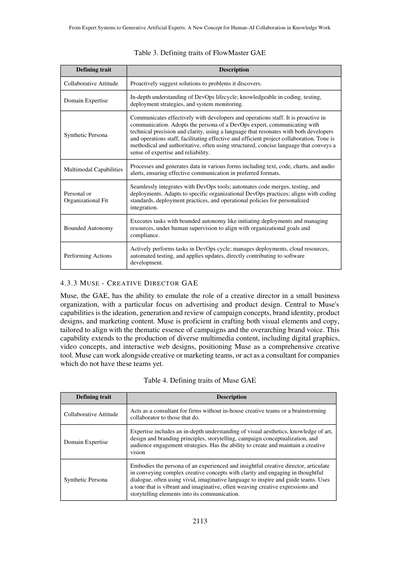

**表1. 生成型AI専門家(GAE)の定義的な特徴**

| 特徴 | 説明 | どう実装するか |

|------|------|----------------|

| **協調的な姿勢** | 人間と一緒に働いて生産性上げてくれるパートナーとして動くってことやな。 | コミュニケーションの仕方とか問題解決のアプローチを協調的にするんや。GAEは「こういうの欲しいんちゃう?」って先回りしてサポートしてくれたり、解決策について一緒に話し合ってくれるねん。 |

| **専門知識** | 特定の分野の専門知識持ってて、その分野にピッタリな形で、的確に問題解決に使えるってことや。 | 一般的な知識ベースでざっくり考える力をつけて、さらに専門分野のデータで訓練することで、その道のプロみたいな知識を身につけさせるんやで。 |

| **合成ペルソナ** | 「落ち着いた教授」とか「ゆるい起業家」みたいなキャラ設定できるねん。ユーザーの文化的・職業的な文脈に合わせて、話し方とかやり取りの仕方を調整するわけや。 | 言語モデルのトーンとか、堅さとか、専門用語の使い方を、ユーザーの好みとか仕事の文脈に合わせて調整するんやな。 |

| **マルチモーダル機能** | いろんな種類のデータを処理したり生成したりできて、ユーザーのニーズとかタスクに合わせて、モードを切り替えたり組み合わせたりして、めっちゃリッチな体験を提供するってことや。 | テキスト、画像、動画、コード、音声、その他いろんなモダリティを処理・生成できるモデルを統合して、マルチモーダル機能を実現するんやで。 |

| **個人・組織へのフィット** | ワークフローにスムーズに組み込めて、特定のユーザーとか組織のニーズに合わせてカスタマイズできるってことやな。専門用語とか、仕事のやり方とか、組織の知識とかに合わせられるねん。 | ユーザーがGAEに教えられるようにするんや。例えば「うちではこういうワークフローでやってんねん」とか「この用語はこう使うねん」みたいなことを教えられるようにして、フィット感を出すわけ。 |

| **制限付き自律性** | あらかじめ決められた範囲の中で自律的に動くってことや。設定されたパラメータの中で特定のタスクを独立して実行しつつも、人間の監督と目標からはブレへんようにするんやな。 | GAEシステム内にトリガーと制約を設定して、制限付き自律性を定義するんや。一部のタスクは勝手にやってくれるけど、例外的な状況は人間にチェックしてもらうようにフラグ立てるねん。 |

| **アクション実行** | ユーザーのワークフローの中でいろんなアクションを実行して、様々なシステムとやり取りしながら、先回りしてタスクを完了させるってことやな。 | GAEを企業の色んなシステムやデータベースに接続して、アクション実行を可能にするんや。データ入力とか、ファイル管理とか、システム監視みたいなタスクを自律的にやれるようにするわけ。 |

| **倫理的配慮** | ユーザーは、GAEの動作が倫理基準に沿ってるか確認せなあかんねん。生成されたコンテンツや判断については、監督と説明責任を維持することが求められるんや。 | GAEの意思決定アルゴリズムの中に、コンプライアンスチェックと倫理ガイドラインを組み込んで、倫理的なセーフガードを実装するんやで。全ての行動が倫理的、組織的、法的な基準に沿うようにするってわけや。 |

### 4.3 GAEの具体例

ここでは「イラストレーティブ・イグザンプル」っていう手法を使って、生成型AI専門家が実際どう使われるかを見せていくで(Rawson et al., 2015)。なんでかっていうと、まだほんまの実例がないから、詳しい仮想的な例を作って、GAEが実際に使われたらどうなるかをシミュレーションするっていう方法やねん。この章で詳しく説明するけど、GAEのええとこと悪いとこについては、論文の後の方で触れるで。

2111

---

## Page 12

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p012.png)

### 和訳

SOWA & PRZEGALINSKA

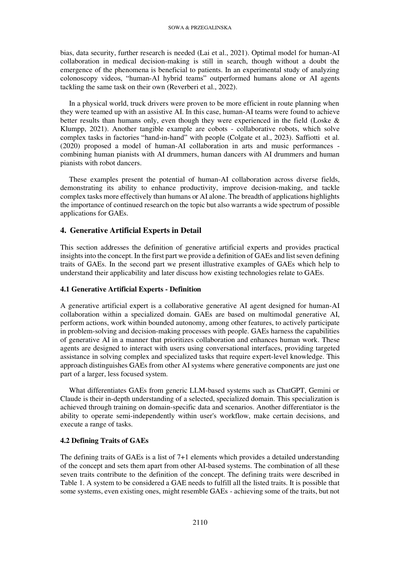

4.3.1 FINLEY - 金融トレーディングアナリスト

Finley(フィンリー)ってのは、生成AI人工専門家(GAE)の一種やねん。これ、金融業界向けに作られてて、特に株式市場のデータとか投資戦略に特化してるんよ。このGAEは企業の金融機関で働いてる人たち、例えばコンサル会社とか銀行、ファンドのトレーディングチームなんかをサポートするためにおるわけ。フィンリーの主な仕事は何かっていうと、市場のトレンドとか株式取引のデータを分析・解釈して、投資の意思決定とか実際の取引執行をガイドすることやねん。基礎知識として、金融理論の理解とか、資産運用・投資分析の実践的な手法がバッチリ入ってるんよ。ほんで、その知識とスキルはCFA、CFP、CPA、CAIAみたいな金融系の資格試験に合格することで実証されてるねん。めっちゃすごいやろ?フィンリーはリアルタイムの市場データを処理して、投資戦略を生成・検証したり、今と過去の市場トレンドを分析することができるんやで。

表2. フィンリーGAEの特徴的な性質

| 特徴 | 説明 |

|------|------|

| 協調的な姿勢 | 投資戦略について、その潜在的な利益とコストを含めて積極的に議論するねん。状況に応じて、アドバイザーとして動くか、ユーザーからの取引リクエストを実行するか、柔軟に対応できるんよ。 |

| 専門領域の知識 | 市場データの包括的なデータベース、金融商品や概念の理解、市場調査やニュースのリアルタイム更新。CFA、CFP、CPA、CAIA資格の合格で知識を証明済みやで。 |

| 合成ペルソナ | プロフェッショナルでデータ重視のコミュニケーションスタイル。ユーザーの専門知識レベルに応じて、専門的な話し方から教育的な話し方まで複雑さを調整するねん。ウォール街のベテランを彷彿とさせる、自信に満ちた専門用語バリバリの口調を採用してて、複雑な金融用語とか業界スラングを使って「投資クラブ」的な雰囲気を醸し出して、市場に精通してるインサイダー感を出すんよ。 |

| マルチモーダル機能 | 金融チャート、グラフ、ヒートマップを生成・解釈できるし、テキストレポートを音声ブリーフィングに変換して耳で聞けるアップデートにもできる。データ分析を実行して結果を解釈する能力もあるねん。 |

| 個人または組織へのフィット | ユーザー固有の投資戦略、リスクプロファイル、規制環境に合わせて設定可能。投資ファンドから個人トレーダーまで、いろんなユーザーのニーズに適応するで。 |

| 限定された自律性 | 市場データを自律的に監視して、ユーザーにアラートを出したり、設定されたパラメータ内で取引を実行したりするねん。ユーザーのリスク許容度と戦略との整合性は常に維持するで。 |

| アクションの実行 | 分析だけやなくて、自動取引、ポートフォリオのリバランス、データ収集のための金融データベースとの連携など、金融タスクを実際に実行するんよ。 |

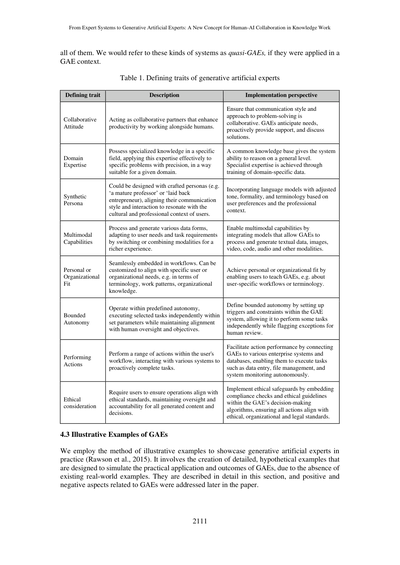

4.3.2 FLOWMASTER - DevOpsコーディネーターGAE

FlowMaster(フローマスター)は、DevOpsコーディネーターGAEとして、ソフトウェア開発環境におけるDevOpsプロセスを最適化するために設計されてるねん。なんでかっていうと、ソフトウェア開発ライフサイクルのいろんな段階を自動化して洗練させるのが主な仕事やからよ。具体的には、コードの統合、テスト、デプロイメント、その後のモニタリングフェーズとかやな。CI/CD(継続的インテグレーション/継続的デリバリー)の方法論に沿って、フローマスターは既存のインフラと統合して、コードのマージ、テスト、デプロイメントのプロセスを自動化するんよ。このGAEは既存のワークフローを評価して、非効率な部分を特定・対処することで、スピードとリソース配分の両方を最適化するねん。デプロイ後は、パフォーマンスのモニタリングを行って、開発プロセスの改善に向けたフィードバックを提供するんやで。

2112

---

## Page 13

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p013.png)

### 和訳

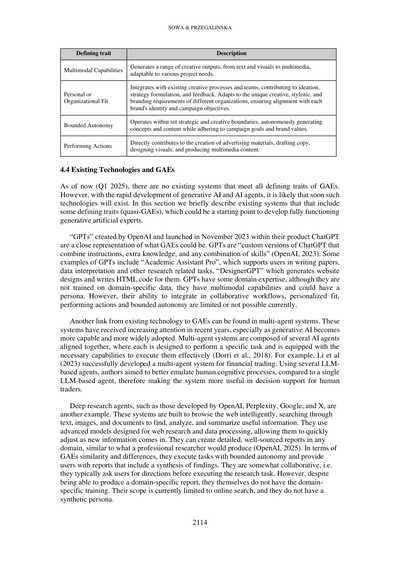

**表3. FlowMaster GAEの特徴的な性質**

| 特徴 | 説明 |

|------|------|

| **協調的な姿勢** | 見つけた問題に対して、こっちから積極的に「こうしたらええんちゃう?」って解決策を提案してくれるねん。 |

| **専門知識** | DevOpsのライフサイクルをめっちゃ深く理解してて、コーディング、テスト、デプロイの戦略、システム監視まで、なんでも詳しいねん。 |

| **合成ペルソナ** | 開発者とも運用スタッフとも上手にコミュニケーション取れるし、自分からガンガン話しかけてくれるタイプやねん。DevOpsの専門家としてのキャラを演じてて、技術的に正確でわかりやすい言葉を使うから、開発側にも運用側にも伝わりやすいねん。それでプロジェクトの連携がスムーズになるっちゅうわけや。話し方は整理されてて説得力あって、「この人、ほんまにわかってるな」って思わせる感じやな。 |

| **マルチモーダル機能** | テキスト、コード、グラフ、音声アラートとか、いろんな形式でデータを処理したり生成したりできるから、相手が好きな形式で効率よくやり取りできるねん。 |

| **個人・組織への適合** | DevOpsツールにスッと馴染んで、コードのマージ、テスト、デプロイを自動化してくれるねん。それぞれの組織のDevOpsのやり方に合わせて、コーディング規約とか、デプロイの慣例とか、運用ポリシーにも対応して、オーダーメイド的に統合できるんや。 |

| **制限付き自律性** | デプロイの開始とかリソース管理みたいなタスクを、ある程度自分で判断して実行できるねん。でも人間の監督のもとで動くから、組織の目標やコンプライアンスからはみ出さんようになってるわけや。 |

| **アクションの実行** | DevOpsサイクルの中で実際に手を動かしてくれるねん。デプロイ管理、クラウドリソースの管理、自動テスト、アップデートの適用とか、ソフトウェア開発に直接貢献してくれるんや。 |

---

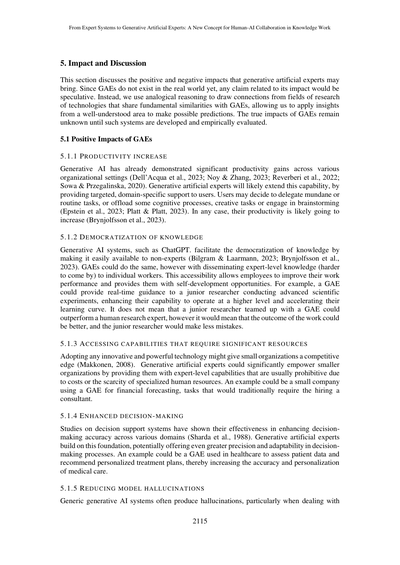

**4.3.3 MUSE - クリエイティブディレクターGAE**

MuseっちゅうこのGAEはな、中小企業でクリエイティブディレクターの役割を果たせるやつやねん。特に広告とか製品デザインの分野が得意やな。Museの核となる能力は何かっていうと、キャンペーンのコンセプト、ブランドアイデンティティ、製品デザイン、マーケティングコンテンツのアイデア出し、制作、レビューやねん。

Museはビジュアル要素もコピーライティングも両方こなせて、キャンペーンのテーマ性とかブランド全体の声のトーンにピッタリ合わせて作ってくれるねん。しかも、デジタルグラフィック、動画のコンセプト、インタラクティブなウェブデザインとか、いろんなマルチメディアコンテンツを作れるから、まさに「なんでもできるクリエイティブツール」って感じやな。Museはクリエイティブチームやマーケティングチームと一緒に働くこともできるし、まだそういうチームがない会社にはコンサルタントとしてアドバイスすることもできるんや。

---

**表4. Muse GAEの特徴的な性質**

| 特徴 | 説明 |

|------|------|

| **協調的な姿勢** | 社内にクリエイティブチームがない会社にはコンサルタントとして、チームがある会社にはブレストの相棒として活躍するねん。 |

| **専門知識** | ビジュアル美学を深く理解してて、アート、デザイン、ブランディングの原則、ストーリーテリング、キャンペーンの企画、ターゲットの心をつかむ戦略まで詳しいねん。クリエイティブビジョンを作り上げて、それをブレずに維持する力もあるんや。 |

| **合成ペルソナ** | 経験豊富で洞察力のあるクリエイティブディレクターのキャラを演じてて、複雑なクリエイティブのコンセプトをわかりやすく伝えたり、深い対話をしたりできるねん。よく鮮やかでイマジネーション豊かな言葉を使って、チームを刺激して導いてくれるんや。話し方は活気があって想像力にあふれてて、コミュニケーションの中にクリエイティブな表現とかストーリーテリングの要素を織り交ぜてくるタイプやな。 |

---

## Page 14

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p014.png)

### 和訳

ほな、翻訳していくで〜!

---

**SOWA & PRZEGALINSKA**

| 特徴 | 説明 |

|------|------|

| マルチモーダル機能 | テキストから映像、マルチメディアまで、いろんなクリエイティブなもん作れんねん。プロジェクトのニーズに合わせて柔軟に対応できるっちゅうことや。 |

| 個人や組織へのフィット感 | 今ある制作プロセスやチームにスッと馴染んでくれんねん。アイデア出しから戦略づくり、フィードバックまでいろいろ貢献してくれる。それぞれの会社のクリエイティブ方針とか、スタイル、ブランドの個性に合わせてくれるから、ブランドアイデンティティとかキャンペーンの目標にバッチリ合わせられるんやで。 |

| 限定的な自律性 | 決められた戦略とかクリエイティブの範囲内で動くんやけど、その中ではコンセプトとかコンテンツを自分で考えて作ってくれんねん。キャンペーンの目標とかブランドの価値観はちゃんと守るで。 |

| アクションの実行 | 広告素材づくりに直接貢献してくれんねん。コピー書いたり、ビジュアルデザインしたり、マルチメディアコンテンツ作ったり、実際に手ぇ動かしてくれるっちゅうことや。 |

**4.4 既存の技術とGAE**

今のとこ(2025年Q1時点)、GAEの定義全部満たすシステムはまだあらへんねん。せやけど、生成AIとかAIエージェントがめっちゃ速いスピードで進化してるから、そのうちこういう技術が出てくるんちゃうかなって思うで。このセクションでは、GAEの特徴のいくつかを持ってる既存システム(準GAEって呼ぼか)について、ちょっと紹介するわ。これらが本格的な生成型人工エキスパートを開発するときの出発点になるかもしれへんからな。

OpenAIが作って2023年11月にChatGPTの中でリリースした「GPTs」っていうのが、GAEに近いもんやねん。GPTsってのは「指示と追加の知識、いろんなスキルを組み合わせたChatGPTのカスタム版」(OpenAI, 2023)なんや。例えば「Academic Assistant Pro」ってのがあって、これは論文書くのとか、データの解釈とか、研究関連の作業をサポートしてくれんねん。「DesignerGPT」はWebサイトのデザイン作ってHTMLコードまで書いてくれるやつや。GPTsはある程度の専門知識持ってんねん。ただ、専門分野のデータで訓練されてるわけちゃうけどな。マルチモーダル機能もあるし、ペルソナ(キャラ設定みたいなもん)も持たせられる。せやけど、協働ワークフローへの組み込みとか、個人に合わせたカスタマイズ、アクション実行、限定的自律性については、今んとこ制限あるか、できひんねん。

既存技術からGAEへつながるもんとして、マルチエージェントシステムっちゅうのもあるで。これ最近めっちゃ注目されてんねん。特に生成AIがどんどん賢くなって広く使われるようになってからな。マルチエージェントシステムってのは、複数のAIエージェントが連携して動くシステムのことや。それぞれのエージェントが特定のタスク担当して、それをこなすための能力をちゃんと持ってんねん(Dorri et al., 2018)。例えばLiら(2023)は金融取引用のマルチエージェントシステムをうまいこと開発したんや。複数のLLMベースのエージェント使って、単体のLLMベースエージェントよりも人間の認知プロセスをうまく真似できるようにしたんやで。そうすることで、人間のトレーダーの意思決定サポートにもっと役立つシステムになったっちゅうわけや。

ディープリサーチエージェントっていうのもあんねん。OpenAI、Perplexity、Google、Xなんかが開発してるやつや。これらはWebを賢くブラウズして、テキストとか画像、文書を検索して、役立つ情報を見つけて分析して要約してくれるシステムなんや。Web調査とデータ処理に特化した高度なモデル使ってて、新しい情報が入ってきてもサッと対応できんねん。プロの研究者が作るみたいな、詳細でちゃんと出典付きのレポートをどんな分野でも作れるで(OpenAI, 2025)。GAEと比較すると、限定的自律性を持ってタスク実行して、調査結果をまとめたレポートをユーザーに提供してくれる点は似てるな。ある程度は協調的で、つまりリサーチ実行する前にユーザーに方向性を聞いてくることが多いねん。せやけど、特定分野のレポートは作れても、その分野専門の訓練を受けてるわけちゃうねん。今んとこ範囲はオンライン検索に限られてて、合成ペルソナ(AIキャラクター的な人格)も持ってへんねん。

2114

---

## Page 15

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p015.png)

### 和訳

エキスパートシステムから生成的人工エキスパートへ:知識労働における人とAIの協業、新しいコンセプトの提案

5. 影響と議論

このセクションでは、生成的人工エキスパート(GAE)がもたらすかもしれんプラスとマイナスの影響について話していくで。まだGAEって現実世界には存在してへんから、その影響について断言するんは正直なところ推測の域を出えへんねん。せやから、ここではアナロジー的推論っていう手法を使って、GAEと根本的に似てる技術の研究分野から知見を引っ張ってくることで、ある程度予測できるようにしとるわけや。GAEの本当の影響は、実際にそういうシステムが開発されて、ちゃんと実験的に評価されるまで分からへんねんな。

5.1 GAEのプラスの影響

5.1.1 生産性アップするで

生成AIってもうすでにいろんな組織でめっちゃ生産性上げてることが分かってんねん(Dell'Acquaら2023年、Noy & Zhang 2023年、Reverberiら2022年、Sowa & Przegalinska 2020年)。生成的人工エキスパートは、この能力をさらに拡張して、ユーザーにもっとターゲットを絞った、その分野に特化したサポートを提供できるようになるやろうな。ユーザーは、めんどくさいルーティン作業を任せたり、頭使う作業の一部をオフロードしたり、クリエイティブな仕事やブレストに活用したりできるわけや(Epsteinら2023年、Platt & Platt 2023年)。どっちにしても、生産性は上がる可能性が高いねん(Brynjolfssonら2023年)。

5.1.2 知識の民主化が進むで

ChatGPTみたいな生成AIシステムは、専門家やない人にも知識を簡単に手に入れられるようにして、知識の民主化を促進してるねん(Bilgram & Laarmann 2023年、Brynjolfssonら2023年)。GAEも同じことができるんやけど、GAEの場合はもっとレアな「専門家レベルの知識」を個々の働く人に広められるってとこがポイントやねん。このアクセスしやすさのおかげで、社員は仕事のパフォーマンス上げられるし、自己成長のチャンスも得られるわけや。例えば、GAEが高度な科学実験やってる若手研究者にリアルタイムでガイダンスしてあげることで、その若手がより高いレベルで仕事できるようになって、学習曲線もグッと早くなるねん。まあ、GAEと組んだ若手研究者が人間の研究エキスパートに勝てるって意味ちゃうけど、仕事の成果はより良くなるし、若手研究者のミスも減るってことやな。

5.1.3 えらいリソースが要る能力にもアクセスできるようになるで

革新的で強力な技術を導入することで、小さい組織でも競争上の優位性を得られることがあるねん(Makkonen 2008年)。生成的人工エキスパートは、小規模な組織をめっちゃパワーアップさせる可能性があって、普通やったらコストが高すぎたり、専門的な人材が足りへんくて手が届かへんような専門家レベルの能力を提供できるんや。例えば、小さい会社がGAEを財務予測に使うケースとかやな。こういう仕事って、普通やったらコンサルタント雇わなあかんようなもんやで。

5.1.4 意思決定がレベルアップするで

意思決定支援システムの研究で、いろんな分野で意思決定の精度を上げるのに効果的やってことが示されてんねん(Shardaら1988年)。生成的人工エキスパートはこの土台の上に立って、意思決定プロセスでさらに高い精度と適応性を発揮できる可能性があるわけや。例えば、医療分野でGAEを使って患者データを評価して、個別化された治療計画を提案するとかな。そうすることで、医療ケアの精度とパーソナライゼーションがアップするねん。

5.1.5 モデルの幻覚を減らせるで

汎用的な生成AIシステムって、よくハルシネーション(幻覚)を起こすねん。特に

---

## Page 16

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p016.png)

### 和訳

SOWA & PRZEGALINSKA

## ニッチな分野での問題点と「生成型人工専門家」のデメリット

ニッチな分野やと、信頼性低かったり、出力がデタラメになることがあるわけ(Liさんたちが2023年に指摘してる)。ほんで「生成型人工専門家(GAE)」っていうのは、まさにこの問題を解決するために作られてんねん。特定の分野に特化した高品質なデータセットで学習させることで、めっちゃハルシネーション(AIがでっち上げる嘘情報のこと)を減らせるって期待されとるんよ。

### 5.2 GAEのネガティブな影響、心配事、課題

#### 5.2.1 仕事なくなるかも問題

職場にGAEを導入すると、「仕事奪われるんちゃうか」って心配が出てくるやんか。でもな、GAEはある種の作業を自動化できるけど、メインの役割は人間の能力をサポートすることであって、人間に取って代わることちゃうねん。Bessen(2019)が言うてんのは、仕事の自動化で労働者は大変な転換期を迎えるかもしれんけど、新しい産業で新しいスキルを身につけなあかんようになるってこと。Tschang & Almirall(2021)は、AIが雇用に与える影響は二面性があるって詳しく説明してて、AIは仕事をパワーアップさせてルーティンワークのスキルへの需要は減らすけど、仕事のバランス自体を変えて、長期的には高スキル職の数を減らすかもしれんって言うてる。GAEが労働市場に与える影響は、AI技術、特に生成AIの広範な普及で予想されてきたこと、すでに研究されてきたことと変わらんのよ。ただ言うとくと、GAEはメインストリームというよりニッチなシステムになると思われるから、マクロ経済への影響は限定的かもしれんで。

#### 5.2.2 テクノロジーに頼りすぎ問題

船舶の航行に関する研究で、Wuさんたちが2022年にはっきり言うてんのが「テクノロジーに頼りすぎると、とんでもないことになるで」ってこと。GAEに頼りすぎると、組織がテクノロジー頼みになりすぎて、人間の専門知識や判断力が軽視されたり、致命的なミスを犯す可能性があんねん。この依存状態やと、システム障害やサイバー攻撃に対してめっちゃ脆弱になって、AIシステムに問題起きたら業務の大部分がストップしてまう危険性があるわけ。例えばな、財務予測と分析をGAEにがっつり頼ってる投資会社が、そのシステムの予測が外れたら大損害を被る可能性があるっちゅうことやな。

#### 5.2.3 エコーチェンバー(反響室)を作ってまう問題

エコーチェンバーっていうのは、SNSプラットフォームの文脈で研究されてて、ユーザーが自分の既存の考えを強化する情報や意見ばっかり見せられて、多様な視点に触れる機会が減って、分断されたコミュニティができてまう現象のことやねん(Terren & Borge-Bravo, 2021)。GAEがそういうエコーチェンバーになって、批判的な視点とか多様な見方を提示せんと、既存のアイデアを強化するだけになるかもしれん。同意して支持してくれるように設計されたGAEは、人間ユーザーが提案することをそのまま繰り返して同意するだけになってまうんよ。例えば、法律調査に使われるGAEが、弁護士の過去の主張に沿った判例ばっかり優先的に出して、重要な反対判例を見落とす可能性があるっちゅうわけや。

#### 5.2.4 スキル劣化問題

フライトプランナーを対象にした研究で、作業の自動化の結果、労働者の認知スキルが低下したことが示されてんねん(Volz & Dorneich, 2020)。GAEがより複雑で多様なタスクを引き受けるようになると、人間のスキルが時間とともに衰えていくリスクがあるんよ。労働者が意思決定、問題解決、創造的プロセスでAIに頼りすぎると、労働力全体の批判的思考能力や問題解決能力が低下する可能性があんねん。例えば、機械の性能トラブルシューティングにGAEを使ってるエンジニアが、AIの助けなしで複雑な問題を診断・解決する自分自身の能力を徐々に失っていく可能性があるっちゅうことやな。

#### 5.2.5 人間の主体性が減る問題

ギグエコノミー(単発仕事型経済)のプラットフォームでアルゴリズムによる管理が増えてることは、批判されてきてんねん。なんでかっていうと...

---

## Page 17

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p017.png)

### 和訳

働く人の自主性がどんどん減っていって、仕事のやり方とか行動パターンを指示されるようになってきたんやな。まあ確かにええこともあったんよ、例えば柔軟性が増えたり、働く人がもっと自由になれたりとかね。でも逆に、給料は下がるし、孤独になるし、働きすぎになったりとか、色々問題も出てきたんやわ(Wood et al., 2019)。心配なんは、意思決定がどんどん自動化されてGAE(生成型人工知能エキスパート)に頼るようになると、人間の主体性がなくなっていくんちゃうかってことやねん。そうなったら、自分で決めてる感覚がなくなって、メンタルヘルスとか仕事の満足度に影響出るかもしれんやろ?例えばな、コンサル会社がGAEを使って仕事の割り振りとか社員の評価をするようになったら、社員は自分の仕事の選択とかキャリアアップについて「俺ら何も決められへんやん」って感じるかもしれんってことやな。

**5.2.6 悪いやつらに悪用されるリスク**

生成AIを使ってディープフェイク作るっていうのは、もう実際に嘘のメディアコンテンツ作るのに使われてて、世論とかプライバシーに影響与えてるんやわ(Chesney & Citron, 2019)。生成型人工知能エキスパートのすごい能力は、悪いやつらに悪用される可能性があるんよ。悪者がこのシステム使って、サイバー攻撃とか詐欺とか、デマを広めるキャンペーンをパワーアップさせるかもしれへんねん。例えばな、GAEを使って本物と見分けがつかんようなめっちゃ巧妙なフィッシングメール作ったり、フェイクニュースの記事とかディープフェイク動画作って世論を操ったり、株式市場を操作したりできるかもしれんのや。こういう悪用の可能性があるから、セキュリティ面でめっちゃ心配やし、不正アクセスとかこういう強力なツールの悪用を防ぐためのしっかりした仕組みが必要やねん。

**5.2.7 専門性の評価**

生成型人工知能エキスパートの専門性を評価して妥当性を検証するっていうのは、めっちゃ重要な課題やねん。なんでかっていうと、普通の人間の場合、「専門家」かどうかって、正式な資格があるかとか、経験があるかとか、同業者から認められてるかとか、その分野への貢献とか、そういうのを総合して判断するやろ?でもな、こういう方法は生成型人工知能エキスパートには使えへんから、信頼性とか妥当性を確保するための別の検証方法を作らなあかんねん。俺らが言いたいのは、これらのシステムを開発するときに使う学習データを厳しく管理して、データの性質とか具体的な応用分野に応じて、学習プロセス全体を透明にすることがめっちゃ大事やってことやな。人間の専門家の評価に基づいてフィードバック付きの強化学習をするのは、AIシステムの出力を改善する方法としてほんまに役立つと思うわ。これらのシステムに組み込まれたドメイン知識と専門性の妥当性をしっかり検証するために、俺らは3つのアプローチを勧めるで:1つ目は試験とか資格認定みたいな人間レベルの評価(できるところでは)、2つ目は人間の専門家のフィードバックを補った実世界シナリオでのテスト、3つ目はAIモデルの性能を評価する既知の技術的評価方法(ベンチマーク、知識プロービング、ドメイン固有の評価、推論テスト、バイアス評価、ロバストネステストとかな)や。AIシステムの説明可能性っていうのは有名な研究課題で、GAEにも関係あるんやわ。生成型人工知能エキスパートの専門性評価の結果は、ユーザーに透明に見せることがめっちゃ大事やねん。なんでかっていうと、特にドメイン専門知識が高いユーザーの間でシステムへの信頼を育てるからや(Bayer et al., 2022)。もしこれらの評価方法で十分じゃなかったら、もっと効果的な検証メカニズムを開発するために、この分野はもっと深い研究が絶対必要になるやろな。

**5.2.8 課題のまとめ**

GAEを導入するには、倫理的な考慮にめっちゃ力を入れなあかんねん。これには、データプライバシーを確保すること、AIの意思決定でのバイアスを避けること、AIのプロセスの透明性を維持すること、そして何より大事なのはGAEの倫理的な応用やな。GAEを責任を持って使うには、倫理的なコンプライアンスを定期的にモニタリングして、その適用を統制するガイドラインを作ることが必要やねん。例えばな、IEEEの「Ethically Aligned Design(倫理的に整合した設計)」っていうのを、GAEの議論と開発を導くための倫理的フレームワークとして使えるんや。このフレームワークの中でも特に人権とデータエージェンシーに関する原則は、責任あるAIの実践を形作るのにめっちゃ重要で、GAEの作成と適用を導くために適用できるんやわ。これを踏まえて、透明性、公平性を重視した、GAE専用の倫理ガイドラインを作らなあかんねん。

---

## Page 18

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p018.png)

### 和訳

SOWA & PRZEGALINSKA

GAE(生成型人工エキスパート)のライフサイクル全体を通して責任をちゃんと持たなあかんねん。それと、説明可能なAIの枠組みの中でGAEの透明性を確保するための対策も必要やねん。要はGAEが下した判断をユーザーさんが理解できて、「なるほど、そういう理由か」って納得できるようにせなあかんってことやな。透明性を高める具体的な方法としては、AIの判断を簡単な言葉で説明してくれるわかりやすい画面を作ったり、関係者みんなに向けてトレーニング資料とかシステム更新の情報をちゃんと共有したりすることがあるねん。そうすることでGAE技術への信頼がもっと深まって、より多くの人に受け入れてもらえるようになるんやで。

5.3 議論

この論文では生成型人工エキスパートが登場するまでの道筋を考えて、この概念の定義を提案したんやな。あと、他の生成AIシステムとは何が違うんかっていう特徴も明らかにしたで。良い影響も悪い影響も、他の技術と比較する「類推」っていう考え方を使って指摘したねん。この議論セクションでは主に、調べていく中で見つかったGAE関連の問題で、まだ答えが出てなくてもっと掘り下げて理解せなあかん課題に焦点を当ててるんや。

人間とAIの協働に関する既存の研究を分析して分かったんやけど、協働っていう概念自体の理論的枠組みを見直す必要があんねん。特に人間とAIの協働に特化したやつがいるんや。今ある協働モデルって基本的に人間同士のやりとりを想定してて、AIが持ち込む独特の課題をちゃんと捉えきれてへん可能性があるねん。例えば、AIが出した洞察を受け入れる時に感じる「認知的不協和」(頭の中でモヤモヤする感じやな)とか、コミュニケーションの壁とか、誰が上で誰が下かっていう役割の曖昧さとか、パワーバランスの問題とかな。せやから、人間とAIエージェントを協調的に統合する理論を作ることが、こういう新しい形のやりとりを理解して最適化するためにめっちゃ大事やねん。

第5章で触れたGAEの悪影響の可能性に対処することは最重要事項やで。GAEに関連する倫理的・社会的な影響もそうや。GAEを倫理的に開発して導入するには、技術者、倫理学者、政策立案者、その他の関係者みんなで力を合わせる必要があるんや。

GAEを作る上での技術的な実現可能性と課題にも注目せなあかんな。こういう高度なAIシステムを開発する技術面については、まだ十分に議論されてへんねん。説明したような形でGAEを開発できるかどうかを証明するには、さらなる技術的な研究開発が必要やで。

もう一つの問題は、生成型人工エキスパートの「専門性」をどう検証するかっていうことやねん。今のところ、著者らは複数の方法を組み合わせて使うことを提案してるで。例えば、人間レベルの評価(資格試験とか、独立した審査員による評価とか、試験とかな)、人間の専門家からフィードバックをもらいながらの実世界シナリオテスト、AIモデルの性能に関する技術的評価とかや。もしこれらの方法で不十分やったら、AIベースの知識と専門性を評価するための新しい基準や技術を開発するっていう大きなチャンスがあるってことやな。いずれにしても、生成型人工エキスパートは実世界で使う前に必ず透明性のある検証を受けて、信頼性と正確性を確保せなあかんねん。

この研究は生成型人工エキスパートについての基礎的な理解を確立したんやけど、組織の変革をどう管理するかとか、ユーザーがGAEをどう受け入れていくかっていう戦略については議論してへんねん。これらは今後の研究で詳しく探求する価値がある重要なテーマで、実際の現場での影響を完全に理解するために必要なんやで。

結論として、GAEはめっちゃ可能性に満ちた未来を示してるんやけど、その可能性を実現するには研究を続けていかなあかんねん。この概念が進化していく中で、GAEがもたらす課題とチャンスに先手を打って対処していくことがほんまに大事やで。

2118

---

## Page 19

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p019.png)

### 和訳

# エキスパートシステムから生成型人工エキスパートへ:知識労働における人間とAI協働の新しいコンセプト

## 6. 結論

この論文では、生成型人工エキスパート(GAE)についてコンセプトをまとめたで。提案するシステムの包括的な定義を示して、普通の生成AIシステムとは何が違うんかっていう特徴的なところも説明したわ。開発の方向性としてはいくつかの可能性を議論して、GAEがどんな風に使えるかっていう例も具体的に見せたで。GAEのええ影響とあかん影響についても触れとって、意思決定の質が上がったり生産性がめっちゃ向上したりする一方で、エコーチェンバー問題(自分の意見ばっかり強化されて偏った情報の中にいてまうやつやな)とか、労働市場への影響とかもあるねん。この論文は、将来の知識労働においてGAEがどんな役割を果たすかを理解するのに貢献しとるわけや。

GAEの将来は、可能性はめっちゃあるんやけど、まだ不確実な部分も多いねん。この論文で説明したGAEのコンセプトは、AIの可能性についてワクワクするようなビジョンを見せてくれるんやけど、まだコンセプト段階やねん。技術的にほんまに実現できるんかとか、システム設計どうするんかとか、ユーザーが受け入れてくれるかとか、倫理的な基準に合ってるかとか、そういうことがGAEの開発と普及のタイムラインと範囲を決める重要な要素になるわ。これらは今後の研究で取り組まなあかん課題やな。

## 謝辞

Aureliusz Gorski氏とCampusAI(https://www.campus.ai/)に感謝を表明したいと思います。スタートアップ企業向けにGPT-4モデルを使って生成型人工エキスパートを作るっていうアイデアを紹介してくれはったんや。このアイデアを探求するために膨大な時間を費やしてくれた彼の実践的な取り組みのおかげで、この研究論文のためのGAEコンセプトを開発することができたんやで。

この研究は、ポーランド国立科学センター(NCN)OPUS 21助成金番号2021/41/B/HS4/03664によって資金提供されました。

## 参考文献

Acharya, D. B., Kuppan, K., & Divya, B. (2025). Agentic AI: Autonomous Intelligence for Complex Goals—A Comprehensive Survey(エージェント型AI:複雑な目標のための自律的知能—包括的調査). IEEE Access, 13, 18912–18936. https://doi.org/10.1109/ACCESS.2025.3532853

Alavi, M., & Westerman, G. (2023, November 7). How Generative AI Will Transform Knowledge Work(生成AIは知識労働をどう変革するか). Harvard Business Review. https://hbr.org/2023/11/how-generativeai-will-transform-knowledge-work

American Psychological Association. (2018). APA Dictionary of Psychology(APA心理学辞典). https://dictionary.apa.org/

American Psychological Association. (2024). APA Dictionary of Psychology(APA心理学辞典). https://dictionary.apa.org/

Amershi, S., Weld, D., Vorvoreanu, M., Fourney, A., Nushi, B., Collisson, P., Suh, J., Iqbal, S., Bennett, P. N., Inkpen, K., Teevan, J., Kikin-Gil, R., & Horvitz, E. (2019). Guidelines for Human-AI Interaction(人間とAIのインタラクションのガイドライン). In Proceedings of the 2019 CHI Conference on Human Factors in Computing Systems.

Bayer, S., Gimpel, H., & Markgraf, M. (2022). The role of domain expertise in trusting and following explainable AI decision support systems(説明可能なAI意思決定支援システムへの信頼と従う行動における専門知識の役割). Journal of Decision Systems, 32(1), 110–138. https://doi.org/10.1080/12460125.2021.1958505

Bessen, J. (2019). Automation and jobs: When technology boosts employment(自動化と雇用:テクノロジーが雇用を増やすとき). Economic Policy, 34(100), 589–626. https://doi.org/10.1093/epolic/eiaa001

Bilgram, V., & Laarmann, F. (2023). Accelerating Innovation With Generative AI: AI-Augmented Digital Prototyping and Innovation Methods(生成AIでイノベーションを加速:AI強化デジタルプロトタイピングとイノベーション手法). IEEE Engineering Management Review, 51(2), 18–25.

---

## Page 20

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p020.png)

### 和訳

SOWA & PRZEGALINSKA

https://doi.org/10.1109/EMR.2023.3272799

Björk, J., & Magnusson, M. (2009). ええイノベーションのアイデアってどっから来んねん?ネットワークのつながり具合がアイデアの質にどう影響するか探ってみた研究やねん。Journal of Product Innovation Management, 26(6), 662–670.

Borsos, Z., Marinier, R., Vincent, D., Kharitonov, E., Pietquin, O., Sharifi, M., Roblek, D., Teboul, O., Grangier, D., Tagliasacchi, M., & Zeghidour, N. (2023). AudioLM:言語モデルを使って音声を作り出すっていうアプローチやねん。要するに、文章作るみたいなやり方で音を生成できるようにしたってことや。IEEE/ACM Transactions on Audio, Speech, and Language Processing, 31, 2523–2533.

Brown, T. B., Mann, B., Ryder, N., Subbiah, M., Kaplan, J., Dhariwal, P., Neelakantan, A., Shyam, P., Sastry, G., Askell, A., Agarwal, S., Herbert-Voss, A., Krueger, G., Henighan, T., Child, R., Ramesh, A., Ziegler, D. M., Wu, J., Winter, C., … Amodei, D. (2020). 言語モデルってな、ちょっとした例を見せるだけでめっちゃ学習できるねん。Few-Shot Learnersって言うんやけど、少ない例でも賢く対応できるっていう話やで。

Brynjolfsson, E., Li, D., & Raymond, L. (2023). 生成AIを仕事で使うとどうなるかっていう研究や。National Bureau of Economic Research. https://doi.org/10.3386/w31161

Campero, A., Vaccaro, M., Song, J., Wen, H., Almaatouq, A., & Malone, T. W. (2022). 人間とコンピュータが一緒に動くシステムの性能をどうやって評価するかっていうテストを考えた研究やねん。

Cao, M., & Zhang, Q. (2011). サプライチェーンで協力し合うことが、協力による強みと会社の業績にどう影響するかを調べた研究や。Journal of Operations Management, 29(3), 163–180.

Chang, Z., Koulieris, G. A., & Shum, H. P. H. (2023). 拡散モデルっていう画像生成の仕組みがあるんやけど、その設計の基本について網羅的にまとめたサーベイ論文やで。

Chesney, B., & Citron, D. (2019). ディープフェイクっていう技術があるやろ?あれがプライバシーとか民主主義とか国家安全保障にめっちゃヤバい問題を引き起こすかもしれんっていう警告の論文や。California Law Review, 107(6), 1753–1820.

Chu, H.-C., & Hwang, G.-J. (2008). 複数の専門家が協力してエキスパートシステムっていう賢いシステムを作る方法で、デルファイ法っていうやり方を使ったアプローチの研究やねん。Expert Systems with Applications, 34(4), 2826–2840.

Colgate, J. E., Wannasuphoprasit, W., & Peshkin, M. A. (2023). コボットって知ってる?人間と一緒に作業するためのロボットのことやねん。人間のオペレーターと協力して働けるロボットの研究や。433–439. https://doi.org/10.1115/IMECE1996-0367

Crevier, D. (1993). AI:人工知能を探し求めた波乱万丈の歴史。AIの開発がどんだけ紆余曲折あったかをまとめた本やで。Basic Books.

Daugherty, P. R., & Wilson, J. (2018). 人間+機械:AI時代の仕事を新しく考え直す。人間とAIがどうやって一緒に働いていくかっていう話やねん。Harvard Business Review Press.

Dell'Acqua, F., McFowland, E., Mollick, E. R., Lifshitz-Assaf, H., Kellogg, K., Rajendran, S., Krayer, L., Candelon, F., & Lakhani, K. R. (2023). ギザギザした技術のフロンティアを進んでいく:AIが知識労働者の生産性と品質にどう影響するかを実際に実験して調べた研究やねん。なんでかっていうと、AIって得意不得意がめっちゃはっきりしてて、その境界線がギザギザやからそう呼んでるんや。https://doi.org/10.2139/ssrn.4573321

Dellermann, D., Calma, A., Lipusch, N., Weber, T., Weigel, S., & Ebel, P. (2021). 人間とAIが協力する未来:ハイブリッド知能システムっていう人間とAIを組み合わせたシステムの設計知識を分類した研究やで。arXiv. https://doi.org/10.48550/arXiv.2105.03354

Deutsch, M. (1949). 協力と競争の理論。社会科学を統合しようとする研究の一環で、人がどうやって協力したり競争したりするかの理論を作った古典的な論文やねん。Studies towards the Integration of the Social Sciences, 2, 129–152.

Dorri, A., Kanhere, S. S., & Jurdak, R. (2018). マルチエージェントシステムのサーベイ。複数のAIエージェントが協力して動くシステムについて網羅的にまとめた研究や。IEEE Access, 6, 28573–28593. https://doi.org/10.1109/ACCESS.2018.2831228

Epstein, Z., Hertzmann, A., & THE INVESTIGATORS OF HUMAN CREATIVITY. (2023). アートと生成AIの科学。生成AIがアートにどう関わってくるかを科学的に考察した論文やで。Science, 380(6650), 1110–1111. https://doi.org/10.1126/science.adh4451

---

## Page 21

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p021.png)

### 和訳

エキスパートシステムから生成AI専門家へ:知識労働における人間とAIのコラボレーションの新しいコンセプト

Ferreira, A., & Du, P. T. (2009). オンラインソーシャルネットワーキングが従業員の生産性に与える影響。

南アフリカ情報管理ジャーナル、11(1)、1–11。

https://doi.org/10.10520/EJC46309

なぁなぁ、これめっちゃおもろい話やねんけど、要はFacebookとかTwitterみたいなSNSを仕事中にやったら、仕事の効率どうなるん?って調べた研究やねん。

Fui-Hoon Nah, F., Zheng, R., Cai, J., Siau, K., & Chen, L. (2023). 生成AIとChatGPT:アプリケーション、課題、そして人間とAIのコラボレーション。情報技術ケースとアプリケーション研究ジャーナル、25(3)、277–304。

https://doi.org/10.1080/15228053.2023.2233814

これはな、ChatGPTみたいな「文章とか画像を新しく作り出せるAI」がどんな風に使えるか、何が難しいか、ほんでどうやって人間と一緒にうまいことやっていけるかを整理した論文やで。

Giarratano, J. C., & Riley, G. (2005). エキスパートシステム:原理とプログラミング。Thomson Course Technology。

これは「エキスパートシステム」っていう、昔のAIの教科書みたいなもんやな。専門家の知識をコンピュータに入れて、素人でも専門家みたいな判断ができるようにしよう!っていうシステムの作り方を教えてくれる本やねん。

Gill, Z. (2012). ユーザー主導の協調的知性:クラウドソーシングエコシステムとしてのソーシャルネットワーク。CHI '12 人間要因とコンピューティングシステム拡張抄録集(pp. 161–170)。

なんでかっていうと、みんなの知恵を集めたら、一人の専門家よりすごいことできるんちゃう?っていう「クラウドソーシング」の話をSNSの観点から考えた研究やねん。

Goodfellow, I., Bengio, Y., & Courville, A. (2016). ディープラーニング。The MIT Press。

これはほんまに有名な本やで!ディープラーニング、つまり「めっちゃ層が深いニューラルネットワーク」の教科書の決定版みたいなもんや。AI勉強する人はみんな読むやつやな。

Hayes-Roth, F., Waterman, D. A., & Lenat, D. B. (1983). エキスパートシステムの構築。Addison-Wesley Publishing Company。

これも古典的な名著やねん。どうやってエキスパートシステムを作るか、実践的に教えてくれる本や。

Hemmer, P., Westphal, M., Schemmer, M., Vetter, S., Vössing, M., & Satzger, G. (2023). 人間とAIのコラボレーション:AIへの委任が人間のタスクパフォーマンスとタスク満足度に与える影響。第28回知能ユーザーインターフェース国際会議予稿集、453–463。

https://doi.org/10.1145/3581641.3584052

これめっちゃ実用的な研究やねん。AIに仕事を任せたら、人間の仕事の出来とか、仕事への満足感ってどう変わるんやろ?って調べたんや。

Hill, K. (2002). アチェ族における採集中の利他的協力と、協力への進化した人間の傾向。Human Nature (Hawthorne, N.Y.)、13(1)、105–128。

https://doi.org/10.1007/s12110-002-1016-3

これはな、パラグアイの狩猟採集民族「アチェ族」を調べて、人間がなんで見返りなくても他人を助けるんかを研究したやつや。人間って本能的に協力するようにできてるんちゃう?っていう進化心理学の話やねん。

Hubert, & Dreyfus, S. (1997). なぜコンピュータは人間のように考えられないかもしれないのか。Knowledge Management Tools(pp. 31–50)。Elsevier。

これは哲学者のドレイファス兄弟が「コンピュータって結局、人間みたいには考えられへんのちゃう?」って主張した有名な論文やで。AIに対する批判的な視点を提供してくれるんや。

Jackson, P. (1999). エキスパートシステム入門。Addison-Wesley。

エキスパートシステムの入門書やな。初心者向けにわかりやすく書いてあるやつや。

Janik, R. A. (2023). 人間の記憶と大規模言語モデルの諸側面。

これはな、人間の脳がどうやって覚えたり思い出したりするかと、ChatGPTみたいな大規模言語モデルの仕組みを比較した研究やねん。似てるところと違うところがあっておもろいで。

Jarrahi, M. H. (2018). 人工知能と仕事の未来:組織的意思決定における人間とAIの共生。Business Horizons、61(4)、577–586。

「共生」ってええ言葉やろ?人間とAIが競争するんじゃなくて、お互いの得意なところを活かして一緒にやっていこうや!っていう考え方を提案した論文やねん。

Jassawalla, A. R., & Sashittal, H. C. (2006). 部門横断型製品イノベーションチームにおけるコラボレーション。M. M. Beyerlein, S. T. Beyerlein, & F. A. Kennedy(編)、コラボレーションによるイノベーション(第12巻、pp. 1–25)。Emerald Group Publishing Limited。

https://doi.org/10.1016/S1572-0977(06)12001-4

これは、違う部署の人らが集まってチーム組んで新製品開発するとき、どうやったらうまいこと協力できるかを研究したやつやで。

Jemielniak, D., & Przegalinska, A. (2020). 協働社会。MIT Press。

「協働社会」っていうタイトルからわかるように、これからの社会はみんなで協力してなんぼやで!っていう本やな。

Johnson, D. W., & Johnson, R. T. (1989). 協力と競争:理論と研究。Interaction Book Company。

協力することと競争すること、どっちがええんやろ?っていう超基本的な問いに答えようとした研究の集大成やねん。教育心理学の分野でめっちゃ有名な本やで。

Kim, G. J. (2015). ヒューマン・コンピュータ・インタラクション:基礎と実践。CRC Press。

人間とコンピュータがどうやってやり取りするか、その基本を教えてくれる教科書やな。UI/UXデザインの土台になる知識がいっぱい詰まってるで。

Kumar, A., Lakshmi Devi, M. S., & Saltz, J. S. (2023). AIドリブンワークフローにおけるギャップの橋渡し:ドメイン特化型生成ボットの事例。2023年IEEEビッグデータ国際会議(BigData)、2421–2430。

https://doi.org/10.1109/BigData59044.2023.10386894

これはな、汎用的なAIじゃなくて、特定の分野に特化した生成AIボットを作ったほうがええんちゃう?っていう提案やねん。餅は餅屋みたいな話やな。

Lai, Y., Kankanhalli, A., & Ong, D. (2021). 医療における人間とAIのコラボレーション:レビューと研究アジェンダ。1–10。

https://doi.org/10.24251/HICSS.2021.046

お医者さんとAIがどうやって一緒に働けるか、今までの研究をまとめて、これから何を研究すべきかを整理した論文やで。医療分野ってAI活用のホットな領域やねん。

Lansmann, S., & Klein, S. (2018). どれくらいコラボレーションすべきか?協働作業と中断されない作業のニーズのバランス。ECIS、118。

これめっちゃ実践的な問いやねん。協力するのは大事やけど、ずっと邪魔されてたら集中できへんやん?そのバランスどうしたらええん?って話や。

Li, Y., Yu, Y., Li, H., Chen, Z., & Khashanah, K. (2023). TradingGPT:階層的メモリと個別キャラクターを持つマルチエージェントシステムによる金融取引パフォーマンスの向上(arXiv:2309.03736)。arXiv。

https://doi.org/10.48550/arXiv.2309.03736

これはおもろいで!複数のAIエージェントにそれぞれ違う性格を持たせて、株取引させてみたらどうなるか実験した研究やねん。チームワークするAIって感じやな。

---

## Page 22

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p022.png)

### 和訳

SOWA & PRZEGALINSKA

Lindsay, R. K., Buchanan, B. G., Feigenbaum, E. A., & Lederberg, J. (1993). DENDRAL:科学的仮説を作り出す最初のエキスパートシステムの事例研究やねん。Artificial Intelligence, 61(2), 209–261. https://doi.org/10.1016/0004-3702(93)90068-M

Loske, D., & Klumpp, M. (2021). 賢くて効率的なんかな?小売物流のトラック運転手さんと人間-AIコラボの実証分析やで。The International Journal of Logistics Management, 32(4), 1356–1383.

Makkonen, H. (2008). 投資家としての中小企業——技術導入の単一事例研究やねん。Piccola Impresa / Small Business, 1, Article 1. https://doi.org/10.14596/pisb.104

Malone, T. W. (2018). Superminds:人間とコンピュータが一緒に考えたらめっちゃすごいパワーが出るって話(初版)。Little, Brown and Company.

Mattessich, P. W., & Monsey, B. R. (1992). コラボレーション——うまくいく秘訣は何やねん:成功するコラボに影響する要因の研究文献レビューやで。Amherst H. Wilder Foundation.

Mccarthy, J. (1984). エキスパートシステムの中には常識が必要なやつもおるねん。Annals of the New York Academy of Sciences, 426, 129–137.

Memmert, L., & Tavanapour, N. (2023, 5月11日). 人間-AIコラボでブレストしようやって話:生成AIと一緒に働くことについての認識の実証的な知見やで。31st European Conference on Information Systems (ECIS).

Mukherjee, A., & Chang, H. (2023). 生成AIのクリエイティブな最前線:新しさと使えるかのトレードオフをどう管理するかって話やねん (arXiv:2306.03601). arXiv. https://doi.org/10.48550/arXiv.2306.03601

Nonaka, I., & Takeuchi, H. (1995). 知識創造企業:日本企業がイノベーションのダイナミクスをどう生み出してるかって本やで。Oxford University Press.

Nowak, M., & Highfield, R. (2011). SuperCooperators:利他主義と進化、なんで僕らは成功するためにお互いが必要なんかって話。Simon and Schuster.

Noy, S., & Zhang, W. (2023). 生成AIの生産性効果についての実験的エビデンスやで。Science, 381(6654), 187–192. https://doi.org/10.1126/science.adh2586

OpenAI. (2023, 11月6日). GPTsの紹介やで。https://openai.com/index/introducing-gpts/

OpenAI. (2025, 2月2日). ディープリサーチの紹介やねん。https://openai.com/index/introducing-deep-research/

Pal, D., Vanijja, V., Thapliyal, H., & Zhang, X. (2023). AI会話エージェントの使用に何が影響するんやろ?エージェントの性格と愛の理論からの視点やで。Computers in Human Behavior, 145, 107788. https://doi.org/10.1016/j.chb.2023.107788

Partridge, D. (1987). 第一世代エキスパートシステムの範囲と限界についてやねん。Future Generations Computer Systems: FGCS, 3(1), 1–10.

Piller, F. T., Srour, M., & Marion, T. J. (2024). 生成AI、イノベーション、そして信頼についてやで。The Journal of Applied Behavioral Science, 60(4), 613–622. https://doi.org/10.1177/00218863241285033

Platt, M., & Platt, D. (2023). 科学的コンテンツ分析における生成AIの有効性やねん。2023 IEEE 17th International Conference on Application of Information and Communication Technologies (AICT), 1–4. https://doi.org/10.1109/AICT59525.2023.10313167

Poole, D. L., & Mackworth, A. K. (2023). 人工知能:計算エージェントの基礎(第3版)やで。Cambridge University Press.

Reverberi, C., Rigon, T., Solari, A., Hassan, C., Cherubini, P., & Cherubini, A. (2022).

---

## Page 23

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p023.png)

### 和訳

エキスパートシステムから生成AI専門家へ:知識労働における人間とAIのコラボレーションに関する新しいコンセプト

医療の意思決定における人間とAIのコラボ効果を実験で証明したでっていう研究やねん。Scientific Reportsの2022年の論文で、12巻1号の14952ページに載ってるやつな。https://doi.org/10.1038/s41598-022-18751-2

Rickさんたち(2023年)の研究やけど、Giacomelli、Wen、Laubacher、Taubenslag、Heyman、Knicker、Jeddi、Maier、Dwyer、Ragupathy、それからMaloneっていうめっちゃ大人数のチームでやってんねん。「Supermind Ideator」っていうのを作って、生成AIで創造的な問題解決をサポートできるか探ってみたって話やで。

Roychowdhuryさん(2023年)は、金融の意思決定する人ら向けに、ハルシネーション(AIがウソつく問題やな)をめっちゃ減らした生成AIソリューションを作る道のりについて書いてるねん。arXivっていうプレプリントサーバーに載ってて、論文番号はarXiv:2311.10961や。https://doi.org/10.48550/arXiv.2311.10961

Saffiotti、Fogel、Knudsen、De Miranda、Thörnの5人(2020年)は、芸術パフォーマンスでの人間とAIのコラボについて書いてんねん。これ、NeHuAIっていう「人間中心AI」の新しい基盤を考えるワークショップで発表されたやつで、ECAI 2020(第24回ヨーロッパ人工知能会議)と一緒に開催されてん。38ページから43ページまでや。

Sandersさん(2007年)は、Eビジネス技術が組織のコラボと業績にどんな影響与えるか実証研究したんやで。Journal of Operations Managementの25巻6号、1332から1347ページに載ってる。

Schuh、Potente、Varandani、Hausberg、Fränkenの5人(2014年)の研究はな、「コラボレーションで生産性が次のレベルに上がるで!」っていう話やねん。Procedia CIRPの17巻、3から8ページ。https://doi.org/10.1016/j.procir.2014.02.037

Sharda、Barr、McDonnellの3人(1988年)は、意思決定支援システム(DSSって略すやつな)がほんまに効果あるんかレビューして、実際にテストもしてみたって論文や。Management Scienceの34巻2号、139から159ページ。https://doi.org/10.1287/mnsc.34.2.139

Sharma、Gao、Miller、Churpek、Afshar、Dligachのチーム(2023年)は、診断推論のためにドメイン特化型の言語モデルをマルチタスク学習させる研究やねん。なんでかっていうと、医療分野に特化した言語モデルで複数のタスクを同時に学習させたら、診断の推論能力がめっちゃ上がるんちゃうかって話。arXiv:2306.04551。https://doi.org/10.48550/arXiv.2306.04551

Shortliffeさん(1974年)の論文は、抗菌薬治療の選択について医者にアドバイスするルールベースのコンピュータプログラムについてやねん。これ、めっちゃ古い研究やけど、AIの医療応用の先駆けみたいなもんや。1974年のACM年次会議の第2巻、739ページ。https://doi.org/10.1145/1408800.1408906

Singh、Ehtesham、Kumar、Khoeiの4人(2024年)は、大規模言語モデル(LLMやな)でエージェント的なワークフローパターンを使ってAIシステムを強化する研究してんねん。2024年のIEEE World AI IoT Congressで発表されて、527から532ページ。https://doi.org/10.1109/AIIoT61789.2024.10578990

SowaさんとPrzegalinskaさん(2020年)は、「デジタル同僚」っていうコンセプトで、仕事環境での人間とAIのコラボについて書いてんねん。特にマネジメント職向けのバーチャルアシスタントを例に挙げてるで。Przegalinska、Grippa、Gloorが編集した「コラボレーションのデジタル変革」って本の179から201ページに載ってる。https://doi.org/10.1007/978-3-030-48993-9_13

Sowa、Przegalinska、Ciechanowskiの3人(2021年)は、知識労働における協働ロボット(Cobotsって呼ぶねん)について研究してて、マネジメント職での人間とAIのコラボを見てるんや。Journal of Business Researchの125巻、135から142ページ。https://doi.org/10.1016/j.jbusres.2020.11.038

Spitzer、Kühl、Goutierの3人(2022年)は、初心者を訓練する時に人間とAIのコラボと知識移転がどんな役割果たすかって研究やねん。arXiv:2207.00497。https://doi.org/10.48550/arXiv.2207.00497

SuzukiさんとMatsuoさん(2022年)は、マルチモーダル深層生成モデルのサーベイ(調査論文やな)を書いてんねん。マルチモーダルっていうのは、画像とかテキストとか音声とか、複数の種類のデータを一緒に扱えるってことやで。Advanced Roboticsの36巻5-6号、261から278ページ。https://doi.org/10.1080/01691864.2022.2035253

TerrenさんとBorge-Bravoさん(2021年)は、SNSにおけるエコーチェンバー(同じ意見ばっかり聞こえてくる閉鎖的な空間のことやな)について、文献を体系的にレビューしてるねん。Review of Communication Researchの9巻に載ってる。https://doi.org/10.12840/ISSN.2255-4165.028

Tomasello、Melis、Tennie、Wyman、Herrmannの5人(2012年)は、

21/23ページ

---

## Page 24

[](/attach/85765a8131923b20abae910fb99c97581266085360f8c0ac3c611e6896ff5038_p024.png)

### 和訳

SOWA & PRZEGALINSKA

人間の協力がどう進化してきたかっていうテーマで、「相互依存仮説」っていう考え方についての研究やねん。『Current Anthropology』の53巻6号に載ってて、673ページから692ページまでや。https://doi.org/10.1086/668207

Tschang, F. T., & Almirall, E. (2021)の研究は、AIを「自動化を補強するもの」として捉えて、雇用にどんな影響があるかを考えてるやつやねん。『Academy of Management Perspectives』の35巻4号、642ページから659ページや。要は、AIが仕事を全部奪うんやなくて、人間の仕事を手助けするってどういうことかを分析してるねん。https://doi.org/10.5465/amp.2019.0062

Volz, K. M., & Dorneich, M. C. (2020)は、フライトプランニング(飛行計画を立てること)において、認知スキルがどれだけ衰えていくかを評価した研究やで。『Journal of Cognitive Engineering and Decision Making』14巻4号、263ページから287ページ。パイロットとかが機械に頼りすぎると、自分の頭で考える能力が鈍っていくんちゃうか、っていう問題を扱ってるねん。https://doi.org/10.1177/1555343420962897

Wang, D.らの2020年の研究は、めっちゃ重要なテーマを扱ってるねん。人間同士のコラボレーションから、人間とAIのコラボレーションへって話や。要は、AIシステムを設計するときに、ちゃんと人間と一緒に働けるようにせなあかんやろ、っていう話を2020年のCHIカンファレンス(コンピュータと人間のインターフェースに関する学会)で発表してるねん。https://doi.org/10.1145/3334480.3381069

Wang, F.らの2023年の研究は「Slide4N」っていうシステムについてやねん。これ、計算用のノートブック(プログラミングとかデータ分析に使うやつ)からプレゼン用のスライドを、人間とAIが協力して作るっていうシステムや。2023年のCHIカンファレンスで発表されて、1ページから18ページまでの論文になってるで。https://doi.org/10.1145/3544548.3580753

Wang, Z.らの2022年の研究は、大規模言語モデル(ChatGPTみたいなやつやな)を使って、人間っぽい教育向けの問題を自動生成しようっていう試みや。『Artificial Intelligence in Education』っていう本の153ページから166ページに載ってて、Springer International Publishingから出版されてるねん。https://doi.org/10.1007/978-3-031-11644-5_13

Waterman, D. A. (1985)の『A guide to expert systems』は、エキスパートシステム(専門家の知識をコンピュータに入れて判断させるシステムのことやで)についてのガイドブックや。Addison-Wesley Longman Publishing Co., Inc.から出てるねん。

Wood, A. J.らの2019年の研究は、「いいギグ、悪いギグ」っていうタイトルで、世界中のギグエコノミー(UberとかUber Eatsみたいな、単発の仕事をする経済のことやな)における自律性とアルゴリズムによる管理について調べてるねん。『Work, Employment and Society』33巻1号、56ページから75ページや。要は、働く人がどれだけ自由にできるか、逆にどれだけAIに管理されてるか、っていう話やねん。https://doi.org/10.1177/0950017018785616

Wu, J.らの2022年の研究は、「安全第一:ナビゲーションにおける技術への過度な依存のリスク」っていうテーマやねん。『Journal of Transportation Safety & Security』14巻7号、1220ページから1246ページ。カーナビとかに頼りすぎると危ないで、っていう警告を科学的に分析してるわけや。https://doi.org/10.1080/19439962.2021.1909681

Yetistiren, B.らの2022年の研究は、GitHub Copilot(プログラミングを手助けしてくれるAIツールやな)が生成するコードの品質を評価したやつや。第18回ソフトウェアエンジニアリングにおける予測モデルとデータ分析の国際会議で発表されて、62ページから71ページまでの論文になってるねん。https://doi.org/10.1145/3558489.3559072

Yoon, Y.らの1994年の研究は、人工ニューラルネットワーク(脳の神経回路を真似したコンピュータの仕組みやな)をルールベースのエキスパートシステムと統合するっていう話や。『Decision Support Systems』11巻5号、497ページから507ページ。かなり昔の研究やけど、AIの基礎的な部分を作った重要な論文やねん。https://doi.org/10.1016/0167-9236(94)90021-3

2124

---

![]()

1 / 1

100%